Моя система является монофонической.

Сусуму Сакума

Первым, кто открыто заявил, что предпочитает моносистемы стереофоническим, стал известный японский самопальщик Сусуму Сакума . Его хобби - проектирование ламповых усилителей, схемы и конструкции которых никак не вписываются в традиционную инженерную логику. И, тем не менее, многие его, казалось бы, абсурдные идеи в последнее время нашли применение в аппаратуре "хай-энд". Напомню, что Сакума одним из первых в мире отказался от использования отрицательной обратной связи и каскадов типа SRPP . Он впервые применил в качестве драйверных каскадов оконечных усилителей мощные лампы, а также заменил межкаскадные RC -связи на трансформаторные. Сам он написал об этом так: "Единственный способ добиться энергичности (energy ) и основательности (frame ) звучания - установить много трансформаторов, хотя я не могу дать этому научного обоснования".

Сакума с недоверием относится к инженерному типу мышления, и потому даже не пытается приводить какие-либо технические аргументы в защиту выбранных им конструкторских решений. На вопрос "Сакума, для кого ты делаешь усилители?" он всегда отвечает: "Я делаю усилители для своего собственного удовольствия, как любитель".

И все же его утверждение, что монозвучание лучше, чем стереофоническое, нельзя рассматривать как невинное чудачество любителя аудио.Заним кроется нечто очень серьезное, то, что, в конце концов, может подорвать идеологию всей индустрии звукозаписи и мирового производства аудиоаппаратуры hi - fi и high end ; а значит, это утверждение несет даже потенциальную угрозу национальной безопасности экономически развитых стран Европы, Америки, Азии, и в частности России. Казалось бы, перед всеобщей угрозой ученые, имеющие отношение к аудио (я имею в виду и членов AES ), должны объединиться и внести в этот вопрос требуемую ясность. Но не тут-то было. В своих исследованиях они стараются избегать тем, актуальных для человечества. Наверное, поэтому ответ на вопрос "стерео или моно?" с научных позиций придется давать мне, такому же, как и Сакума, только российскому, любителю аудио.

Сначала я со всей тщательностью повторил неизвестные большинству аудиофилов эксперименты Сакумы по субъективному сравнению стереофонического и монофонического звучания. В ходе экспериментов я сравнивал звучание грамзаписей, воспроизведенных через одноканальную систему (с одним громкоговорителем), с их звучанием через двухканальную систему (с использованием двух громкоговорителей) по признакам, приведенным в методике аудиоэкспертизы . В процессе прослушивания проигрывались грамзаписи, сделанные в период с 1900 по 1963 год через аудиосистему, описанную в "АМ" № 2 (31) 2000, с. 121-124. При проигрывании грампластинок на 78 об/мин я использовал головку звукоснимателя фирмы " Siemens ", а для грамзаписей Lp - головку звукоснимателя " Sumiko Blue Point ", включенную через самодельный ламповый стереофонический предусилитель. В монофоническом режиме был задействован один канал аудиосистемы, причем при воспроизведении Lp выходные обмотки головки " Blue Point " были соединены последовательно. Музыкальным материалом служили записи оркестровых произведений, выполненные с применением разных микрофонных техник, так как именно они позволяют наилучшим образом выявить преимущества "двухушного" слушания музыки перед "одноухим" (более подробно об этом будет сказано ниже).

Использованные при проведении экспериментов грамзаписи

1. Spain . Chicago SO, F. Reiner ("RCA Victor", LSC-2230; "Living Stereo")

2. Saint-Saens. Concerto № 2, A. Rubinstein (piano), Symphony of the Air, A. Wallenstein ("RCA Victor" LSC-2234; "Living Stereo")

3. Beethoven. Symphony № 3 in E Flat op. 55 "Eroica", Pittsbufgh SO, W. Steinberg ("Command classic" CC11019 CD)

4. Bartok. Concerto for Orchestra, Berlin PO, H. Karajan ("Deutsche Grammophon" 2535202)

5. Rimsky-Korsakov. Scheherazade op. 25, New York PO, L. Bernstein ("Columbia" ML 5387)

6. Schumann. Symphony № 2 in c major op. 61, The Stadium Concerts SO, L. Bernstein ("Music Appreciation Records" MAR 575 А )

7. Beethoven. Symphony № 3 in E Flat op. 55 "Eroica", (4 th Mov.), London PO, S. Koussevitsky ("Victor" 8673)

8. Dukas. L’apprenti Sorcier, PSO of New York, A. Toscanini ("Victor", 7021)

9. Rossini. Guglielmo Tell (Sinfonia), Corpo di Musica, P. Nevi ("Fonotipia" № 62227)

Примечание. Номера 1 и 2 выполнены с использованием микрофонной техники А-В;

номера 3 и 4 - с использованием полимикрофонной техники;

остальные грамзаписи монофонические; грамзапись 9 - акустическая.

Выводы

1. Монофоническое звучание (то есть через один громкоговоритель) проигрывает стереофоническому по уровню баса , однако выигрывает в части его артикуляции (речь идет о характере звукоизвлечения).

2. Монофоническое звучание во всех музыкальных регистрах воспринимается как более ясное; при этом мешающее действие реверберации в комнате при монозвучании гораздо менее заметно, чем при стерео-.

3. Стереофоническое воспроизведение воспринимается слушателем как менее энергичное, менее динамичное, а также как более "мутное".

4. Пространственное впечатление, прежде всего проработка планов в глубину, при моновоспроизведении более реалистичное.

5. Целесообразность и связанность всех элементов звучания при монофоническом воспроизведении воспринимаются как более отчетливые.

Результаты прослушивания заставили меня поверить в правильность кажущегося на первый взгляд абсурдным утверждения Сакумы о преимуществах монофонического звуковоспроизведения перед стереофоническим, особенно меня удивило, что это преимущество сохраняется при проигрывании стереозаписей.

Попробую дать психофизическое обоснование этому явлению. Для начала разберемся, что же такое пространственный слух. Академическая наука главным предназначением пространственного слуха считает способность слушателя определять местоположение источника звука в горизонтальной и вертикальной плоскостях относительно головы слушателя, а также его удаленность. Это явление называют пространственной локализацией. Рассмотрим механизм пространственной локализации в горизонтальной плоскости. Начнем с общеизвестного - с того, что в нем задействован подсознательный анализ сходства и различия сигналов, формирующихся в правом и левом ухе. Если сигналы одинаковы, то происходит их слияние и перед слушателем возникает слуховой образ источника. Если они имеют различия по времени прихода в правое и левое ухо (в пределах от 0 до 630 мкс) или несколько отличаются по интенсивности, например из-за экранирующего действия головы слушателя, то в сознании слушателя эти сигналы также сливаются, однако слуховой образ воспринимается как смещенный в сторону уха, которое получило опережающий или более громкий сигнал. Поскольку при формировании ощущения направления на источник звука мозг оценивает только упомянутые различия ушных сигналов , то его нетрудно обмануть, имитируя такие различия с помощью двух расположенных по разные стороны от слушателя громкоговорителей. Например, подобрав различия в задержке и уровне сигналов, воспроизводимых этими громкоговорителями, можно не только создать между ними несуществующий, так называемый фантомный источник звука, но также влиять на его расположение в пространстве между громкоговорителями. Впервые эту возможность подметил А. Блюмляйн в 1931 году. Из-за огромной значимости пространственного слуха для будущего аудиоиндустрии ученые, имеющие прагматический склад ума, всерьез занялись исследованием этого явления. Естественно, что в первую очередь их внимание было сосредоточено на способности слушателя локализовать источники звука в горизонтальной плоскости, а также на изысканиях способов обмануть эту способность. И вскоре такие способы удалось найти.

Было установлено [З], что механизмы локализации - временной (фазовый), опирающийся на различия в запаздывании сигналов, и уровневый, учитывающий различия этих сигналов по уровню громкости, - мозг слушателя использует как бы независимо друг от друга.

Этот тщательно проверенный научный факт был с восторгом принят в аудиоиндустрии, так как открыл возможность получать стереоэффект в аудиоаппаратуре, не затрудняя себя копированием естественных различий ушных сигналов, а создавая лишь их временные или уровневые различия. В результате, в стереозаписи стали широко применяться соответствующие микрофонные техники.

К первой группе относят техники, основанные на использовании различий интенсивности стереосигналов, так называемая стереофония по интенсивности (intensivity stereo ), в которых временные (фазовые) различия этих сигналов были полностью нивелированы. В их число входят системы Блюмляйна, Х/ Y , М/ S , а также полимикрофонные.

Ко второй группе - техники, основанные на временных различиях стереосигналов (time based stereo ), почему-то называемые у нас фазовой стереофонией. Это, прежде всего система А-В, а также ORTF , SASS и другие. Более подробно о микрофонных техниках см. в "АМ" № 4 (5) 95, с. 66-73.

Известно, что подавляющее большинство современных звукозаписей (около 90%) делается с помощью микрофонных техник интенсивностной стереофонии. Такой крен в звукозаписи многие и сейчас не считают ошибочным, поскольку для этих в своем роде коммунистов основная задача пространственного слуха остается прежней - неуклонно, причем с большой точностью, определять направление на главный источник звука. Конечно, если вы охотник или, наоборот, вынуждены убегать от злобных хищников, эта задача и впрямь является для вас жизненно важной. Однако когда вы идете не на охоту, а на музыкальный концерт, возникает естественный вопрос: какую роль выполняет пространственный слух в концертном зале? Думаю, что читатель согласится со мной в том, что расположение музыкальных инструментов на сцене не может быть жизненно важным для слушателя и что на восприятие музыки, ради которого, как мне кажется, он пришел на концерт, оно не оказывает решающего влияния. Ведь это расположение, за редким исключением, выбирается дирижером с тем, чтобы было проще общаться с музыкантами, а также балансировать громкость звучания инструментов. Зачем же тогда нужен пространственный слух при слушании музыки? Оказывается, он необходим для того, чтобы мозг слушателя мог произвести так называемое бинауральное освобождение от маскировки .

Эту свойственную каждому нормальному человеку способность демонстрирует известный опыт . Если источник звука S и источник помехи N находятся в горизонтальной плоскости в разных направлениях относительно слушателя (например, под углом 90°), то порог слышимости при маскировке полезного звука помехой понижается на 9 дБ по сравнению со случаем, когда эти источники располагаются в одном направлении относительно головы слушателя. Последний вариант соответствует общеизвестным данным о маскировке.

Именно благодаря бинауральному освобождению от маскировки живое звучание рассредоточенного на сцене оркестра становится ясным и прозрачным, в нем прорисовывается множество деталей, слушатель может воспринимать каждый инструмент в отдельности, субъективно отделять прямой звук от реверберации, не обращать внимания на чихание и кашель в зале и тому подобное. О том, что мы неосознанно прибегаем к такому освобождению, свидетельствует хотя бы опыт каждого джентльмена вести на вечеринке интимный разговор с соседкой, не замечая при этом шума, создаваемого другими участниками встречи. Эта способность получила название эффекта коктейльной вечеринки (cocktail party - effect ) . Кстати, он исчезает, как только вы затыкаете одно ухо. Советую вам проверить это на себе, сравнив восприятие музыки в концертном зале при "одноушном" и "двухушном" слушании.

Для нас же главный вопрос заключается в том, может ли стереосистема, способная вызвать у слушателей устойчивую локализацию фантомных источников звука, обеспечить одновременно их освобождение от маскировки звучанием других источников, находящихся на той же сцене, но под другим углом к слушателю. Вопрос этот закономерный, так как вовсе не очевидно , что локализация источников звука и бинауральное освобождение от маскировки обеспечиваются одними и теми же механизмами слуха. Оказывается, исследованием этого вопроса практически никто не занимался, хотя психофизическая наука породила одно - впрочем, достаточно убедительное - предположение, что эффект освобождения достигается в результате текущей кросскорреляционной переработки ушных сигналов мозгом слушателя , . Из теории корреляционных функций известно, что сигнал можно отделить от помехи, если от полезного источника мы получаем не один, а пару сигналов, которые когерентны между собой и отличаются от сигналов-помех относительным запаздыванием , иначе говоря - временем отставания одного сигнала в паре от другого. Такой способ вычленения полезных сигналов был назван кросскорреляционным, или - индикацией .

|

|

|

Рис. 1. Прохождение сигналов от естественных точечных источников звука до ушей слушателя от полезного S и от помехи N : а) схема прохождения сигналов ( - угол между направлением на источник и осью симметрии головы слушателя в горизонтальной плоскости); б) временные различия ушных сигналов для случая, когда эти сигналы – короткие импульсы (где и - относительные запаздывания ушных сигналов от источников S и N ) |

Естественные звуки, которые воспринимает слушатель, как видно на рис. 1а, несут его мозгу достаточную информацию для приведения в действие кросскорреляционного способа освобождения полезного сигнала от помех. На этом рисунке в горизонтальной плоскости изображены два находящихся в разном направлении относительно головы слушателя источника звука: S - источник полезного сигнала, и N - источник помехи. От каждого из них слушатель улавливает по паре сигналов. Понятно, что сигналы в каждой такой паре имеют между собой большое сходство и поэтому когерентны, тогда как по относительному запаздыванию они не равны друг другу. Последнее объясняется характерной для каждого положения источника в пространстве неодинаковостью расстояния до левого и правого ушей слушателя. Именно различие относительных запаздываний, обозначаемое мной неравенством (см. рис. 1б), имеет решающее значение для кросскорреляционного освобождения сигналов источника S от маскировки сигналами источника помех N . Для слуха человека относительное запаздывание, соответствующее определенному местоположению источника звука в окружающем пространстве, равно (где - максимально возможное различие ушных сигналов по времени, составляющее 630 мкс;

Угол на горизонтальной плоскости между осью симметрии головы слушателя и проекцией на нее направления на источник).

Текущий кросскорреляционный анализ, осуществляемый, как предполагается, мозгом слушателя, с одной стороны, объединяет пару когерентных ушных сигналов в один слуховой объект, с другой - сохраняет в подсознании как пароль информацию об относительном запаздывании. Последнее вполне естественно, так как аргументом кросскорреляционной функции является не текущее время, а именно это запаздывание.

Чем больше отличие относительных запаздываний сигналов, исходящих от источников S и N , тем больше различаются их кросскорреляционные функции, а значит, тем лучше мозг обособляет полезный сигнал. Что любопытно, кросскорреляционный способ предоставляет слушателю возможность отличить сигнал от помехи, даже когда они мало отличаются друг от друга (например, если и те и другие сигналы - щелчки, как показано на рис. 1б) и звучат одновременно. Кросскорреляционное разделение слухом сигналов наблюдается, даже когда сигналы от источника S когерентны, а от источника N некогерентны. Это подтверждается фактом, что в реальных условиях восприятию прямого звука диффузное поле реверберации не мешает.

Достоинством корреляционной модели является то, что она математическая, а значит, все ее возможные, а также невозможные следствия легко предсказуемы. Например, модель эта, корректно раскрывает механизм бинаурального освобождения полезного сигнала от маскировки, но при этом она бессильна объяснить , как происходит выделение информации, необходимой для формирования ощущения направления на источник звука, из уровневых различий. Но, как говорится, нет худа без добра. Наэтот раз научное противоречие даже принесло некоторую пользу, так как подтвердило мою точку зрения относительно того, что механизмы локализации и бинаурального освобождения от маскировки по своей сути должны быть совершенно разными.

Если обдумать сказанное, то остается признать, что накопленные наукой и широко использованные в стереофонии знания о пространственной локализации, а также все хитрости, придуманные ради того, чтобы обмануть механизмы локализации для достижения так называемого стереоэффекта, можно спокойно выбросить на свалку. Резкость моего заявления оказывается оправданной, если считать феномен бинаурального освобождения главным при двухушном восприятии музыки. Надеюсь, что хотя бы меломаны меня в этом поддержат.

Попробуем теперь хотя бы качественно оценить способность обычных стереофонических звукозаписей, выполненных с применением известных микрофонных техник, и воспроизводящей стереосистемы с двумя громкоговорителями донести до слушателя не только информацию, необходимую для правильной локализации источников звука, но и ту, которая гарантирует проявление феномена бинаурального освобождения. Хотелось бы поверить в способность аудиоаппаратуры вызывать у слушателей оба названных эффекта. Однако оказалось, что стереозаписи, выполненные с применением микрофонных техник, работа которых основана на улавливании только различий в интенсивности стереосигналов, принципиально не способны донести до слушателя информацию, необходимую для срабатывания указанного механизма освобождения. Это означает, что мозг слушателя, который непрерывно высчитывает текущие кросскорреляционные функции ушных сигналов, при прослушивании таких стереозаписей в результате действия названного механизма воспримет все источники звука как условно находящиеся на одной оси в пространстве между громкоговорителями, тогда как локализоваться на стереосцене они будут в разных направлениях - что само по себе даже забавно. Этот пример иллюстрирует версию о различии между механизмами локализации и пространственного освобождения от маскировки. Получается, что из-за отсутствия временных (фазовых) различий между ушными сигналами стереозапись, сделанная с использованием микрофонных техник интенсивной стереофонии, в принципе не может звучать более ясно и прозрачно, чем монофоническая.

|

|

|

Рис. 2. Прохождение сигналов от источников звука S и N до ушей слушателя через стереосистему, включающую два встроенных в искусственную голову микрофона и два разнесенных громкоговорителя: а) схема прохождения через стереосистему до ушей слушателя сигналов от источников S и N ; б) временные различия ушных сигналов для случая, когда эти сигналы – короткие импульсы и попадают в уши слушателя через стереосистему (где и - относительноезапаздывание сигналов от источников S и N на выходе встроенных в искусственную голову микрофонов; и - относительное запаздывание ушных сигналов от правого и левого громкоговорителей) |

Менее очевидной может показаться утрата информации, необходимой для бинаурального освобождения в тех случаях, когда стереозаписи выполнены с использованием микрофонных техник фазовой стереофонии. Чтобы убедиться в том, что эта утрата все же происходит, рассмотрим рис. 2а. Здесь изображено прохождение сигналов от тех же источников S и N к слушателю через стереосистему, то есть дополнительно через два микрофона, встроенные в искусственную голову, и затем через два разнесенных громкоговорителя. На первый взгляд, мы имеем идеальный, "экологически чистый" вариант донесения до слушателя всей пространственной информации. Но, не будем спешить с выводами и сравним эту схему со схемой прохождения сигналов от тех же источников в естественных условиях (рис. 1а). Оказывается, при прослушивании стереосистемы слушатель улавливает вдвое большее количество ушных сигналов, чем в естественных условиях. В их числе - пара когерентных сигналов, сообщающих о местоположении источника полезного сигнала в правом громкоговорителе, и пара с информацией о местоположении того же источника в левом громкоговорителе. Аналогичным образом слушатель воспримет пары когерентных сигналов, оповещающих о местоположении там же двух источников помех. Конечно, мозг слушателя попытается распознать временные различия в парах ушных сигналов, соответствующих фантомам полезного источника и источника помех, но тогда он воспримет их как слабо когерентные. Спутанность ушных сигналов, соответствующих фантомным источникам звука, хорошо видна на рис. 2б. Плохо то, что она возникает на отрезке времени, совпадающем с активным воздействием на восприятие первой волны звука. Из-за этой, как оказалось решающей, неразберихи в сигналах мозг слушателя в стремлении освободиться от маскировки, как это предписано "моделью предпочтений Османа" , предпочтет фантомным источникам реальные, то есть правый и левый громкоговорители, хотя в них полезный сигнал и помеха уже неразделимы. Таким образом, ожидаемый эффект освобождения от маскировки и в этом случае должен либо отсутствовать совсем, либо быть очень слабым, особенно если к этому добавить фазовые рассогласования каналов стереосистемы, возникающие, например, в результате распада поверхности диффузоров громкоговорителей на независимые зоны излучения.

Даже при беглом ознакомлении с рисунками бросается в глаза главная причина утраты когерентности ушных сигналов, соответствующих фантомным источникам - это перекрестные сигналы (то есть сигналы из правого громкоговорителя в левое ухо, и наоборот). Эти противоестественные сигналы к тому же слегка опаздывают, примерно на 100 мкс, так как проходят более длинный путь, чем прямые. Именно из-за добавления этих сигналов мы ощущаем такое разительное ухудшение пространственного впечатления при стереовоспроизведении по сравнению со слушанием в естественных условиях. Эту разницу нельзя было не заметить, и некоторые прогрессивные несоветские ученые заинтересовались влиянием перекрестных сигналов на пространственное восприятие, в частности, на когерентность ушных сигналов . Более того, в 1962 году М. Шредеру и Б. Аталу в лабораторных условиях удалось при воспроизведении через два разнесенных громкоговорителя исключить перекрестные сигналы, впервые применив их электрическую компенсацию. Спустя 7 лет П. Дамаске и В. Меллерт , а также Р. Кюрер, Г. Пленге и Г. Вилкенс создали пригодные для промышленного производства системы, в которых также была применена компенсация перекрестных сигналов. Через 16 лет в СССР автором статьи с группой сотрудников было смакетировано устройство для электрической компенсации перекрестных сигналов в трехмесячный срок. Срок был установлен приказом министра промышленности средств связи. Об этом достижении было сообщено в газете "Социалистическая Индустрия" от 25 февраля 1979 года. Но это уже чисто советская история. Помню, я сделал тогда несколько записей оркестра с балкона в Большом зале Ленинградской филармонии с помощью двух микрофонов, встроенных в искусственную голову. Эти записи, воспроизведенные через обычную стереосистему и устройство для компенсации перекрестных сигналов, звучали, несмотря на грубое нарушение музыкального (инструментального) баланса, поразительно ясно, но тогда всех, и присутствовавшего журналиста из газеты, взволновала удивительная локализация источников звука. Особый восторг вызвала демонстрация специальной записи того, как мотоциклист разъезжает вокруг слушателя.

Именно тогда аудиотехника имела шанс пойти по пути улучшенной стереофонии (названной бинауральной ), но, по-видимому, всемирная звукорежиссерская мафия каким-то образом воспрепятствовала этому .

Одержав победу над здравым смыслом, звукорежиссеры не стали задумываться о вреде перекрестных сигналов. Осуществляя стереозаписи, они пошли по пути искусственного конструирования стереосцены, а также добивались ясного звучания с помощью звукорежиссерского пульта. Именно он дал возможность балансировать громкость звучания музыкальных инструментов, устанавливать соотношение прямого звука и реверберации, выбирать ее параметры и т. п. Понятно, что в этой работе без полимикрофонной техники и искусственной реверберации было уже не обойтись. Поскольку первичного звукового пространства в стереозаписях совсем не оставалось, чисто конструкторская работа звукорежиссера, называемая сведением, была признана творческой и попала под защиту Закона "Об авторском праве и смежных правах".

Стоит ли упрекать звукорежиссеров за самозащиту? Ведь если бы в стереозвучании был задействован феномен бинаурального освобождения от маскировки, то их работа по сведению стала бы никому не нужна. Достаточно вспомнить, что на музыкальном концерте слушатель не испытывает больших неудобств от плохого музыкального баланса или от неоптимального соотношения прямого звука и реверберации. Однако если бы он не обладал способностью бинаурального освобождения, скажем, имел бы только одно ухо, то для того, чтобы выбрать себе подходящее место в концертном зале, ему пришлось бы нанимать специалиста по рассаживанию слушателей, например проф. В. Рейхардта.

Тут, я думаю, настал момент вывести на сцену оппонирующего мне аудиофила: "То, к чему вы склоняете нас, совсем не «внушает»! Ну не удалось достичь непонятного широкой публике эффекта, и что? Стереофоническая пластинка от этого хуже монофонической не стала! Зато как интересно из своей каморки наблюдать за гигантской стереосценой".

При всей привлекательности наблюдений из каморки хочу заострить внимание читателей на потерях в музыке при прослушивании звукозаписи через два громкоговорителя, причем вне зависимости от того, является ли она стереофонической или монофонической. Ничего неожиданного здесь нет, если вспомнить, что для ясного восприятия слушателем музыки решающее значение имеет точная передача в оба уха первой волны звука. Первая волна звука сначала мобилизует внимание слушателя, а затем включает торможение восприятия, в результате чего в следующий период порядка 30 мс ощущение слуховых объектов будет подавлено. Описанные явления получили название "эффекта Хааса" ).

Первая волна звука выполняет свою роль меньше чем за 1,5 мс, поэтому ранние отражения в помещении, обязанные своим появлением этой волне, из-за своего неизбежного запаздывания не успевают ее исказить или видоизменить. Получается, что первая волна звука (разумеется, только в естественных условиях слушания) всегда приходит не от двух-, а от одноточечного источника, а значит, формирует когерентные ушные сигналы. Некогерентные оставляющие, обусловленные, например, остаточной от предшествующего сигнала реверберацией, выпадают из внимания слушателя, так как оказываются в зоне либо упомянутого выше торможения, либо действия бинауральной маскировки.

Эволюция органа слуха человека и животных распорядилась так, что когерентность ушных сигналов, полученных от первой волны звука, в дополнение к ее пусковому действию усиливает внимание слушателя на начале каждого звука и на зонах их членения . Нетрудно догадаться, что усиление внимания слушателя именно к этим зонам на уровне субъективных ощущений должно проявиться как дополнительное прояснение структуры звучания.

Теперь вернемся к аудиосистеме с двумя разнесенными громкоговорителями. "Все самое лучшее" о ней уже сказано, а именно: из- за перекрестных сигналов и фазовых различий каналов она ни в какой момент времени принципиально не способна передать ушам слушателя когерентные сигналы, соответствующие фантомным источникам звука. А это, как я писал выше, значит, что их бинаурального освобождения от маскировки практически не происходит. Аудиосистема с одним громкоговорителем (то есть являющаяся точечным источником), наоборот, всегда производит когерентные ушные сигналы, однако без необходимых для освобождения от маскировки различий относительных запаздываний, например соответствующих распределению источников звука на сцене студии записи. Иными словами, стереофоническое звучание должно в меньшей степени акцентировать внимание слушателя на структуре музыкальных звуков, несмотря на то что и стереофоническое и монофоническое звучания обеспечивают почти одинаковый нулевой эффект освобождения от маскировки. Именно этим я объясняю наблюдаемый в эксперименте (см. таблицу) субъективный прирост ясности, динамики и энергичности при одноканальном прослушивании по сравнению с двухканальным. По рассмотренным причинам стереозвучание приходится воспринимать не как естественное, а как противоестественное.

И еще: в неидеальных акустических условиях, например в обычной жилой комнате, моносистема всегда выиграет у стереосистемы по ясности звучания. Это преимущество вызвано более выраженным, чем при стереофоническом воспроизведении, эффектом освобождения "мономузыки" от маскировки отражениями в помещении. Улучшенный эффект освобождения объясняется все тем же: монофоническая система формирует когерентные ушные сигналы. В связи с этим возникает вопрос, почему специалисты по озвучиванию концертных площадок стараются как можно дальше друг от друга рассредоточить громкоговорители на сцене и в зале, то есть сделать их звучание для слушателя менее когерентным.

Лично меня, уже три месяца назад осуществившего переход на монофоническое звучание, плохая акустика комнаты прослушивания перестала беспокоить.

В однойиз следующих статей я подробно остановлюсь на том, какие особенности конструкции должна иметь монофоническая аудиосистема, где в комнате лучше расположить громкоговоритель, а также расскажу о моей новой привязанности - низкочастотном громкоговорителе фирмы " Klangfilm " (Германия, 1940-е годы) – см. фото 1.

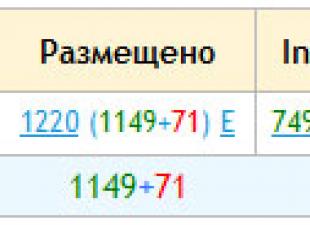

Результаты сравнения звучания

Таблица

|

Признаки звучания |

Стереозаписи |

Монозаписи |

|||||||||||||||||||

|

А-В мк.техн. |

Поли-мк. техн. |

На 33 1 / 3 об/мин |

На 78 об/мин |

||||||||||||||||||

|

Воспроизведение |

|||||||||||||||||||||

|

2-канальное |

1-канальное |

2-канальное |

1-канальное |

2-канальное |

1-канальное |

2-канальное |

1-канальное |

||||||||||||||

|

Тональный баланс |

|||||||||||||||||||||

|

Тональная чистота |

|||||||||||||||||||||

|

Пространственное впечатление |

|||||||||||||||||||||

|

Ясность |

Разборчивость |

||||||||||||||||||||

|

Детальность |

|||||||||||||||||||||

|

Характер звукоизвлечения |

|||||||||||||||||||||

|

Передача интонации |

|||||||||||||||||||||

|

Раздельность-связанность звуков |

|||||||||||||||||||||

|

Динамические контрасты |

|||||||||||||||||||||

|

Динамическиеоттенки |

|||||||||||||||||||||

|

Натуральность тембров |

|||||||||||||||||||||

|

Индивидуальность тембров |

|||||||||||||||||||||

| . Audio Technology MJ Musen to Jikken , October , 1985. | |||||||||||||||||||||

И снова хочу затронуть один из вопросов, будоражащих пытливые умы начинающих, да и не только, аранжировщиков и звукорежиссеров. Вопрос о том, как записывать синтезаторы, при создании аранжировок – в моно или в стерео .

Скажу честно, меня этот вопрос мучил очень долгое время, и я сам с трудом шел к осознанию того, что моно и стерео – это всего лишь два разных режима, и ни в коем случае не свидетельство превосходства одного из них над другим. То есть, запись в один канал – это не ущербность по сравнению с записью в два канала, это просто альтернативный вариант.

Для многих смириться с необходимостью частой работы в моно представляется сложной задачей. Оно и понятно – аранжировщик хочет, чтобы его работы звучали масштабно, объемно, мощно! А при сравнении в лоб записей, сделанных в моно и в стерео, слышимое преимущество в большинстве случаев оказывается не в пользу первого. Естественно, я говорю о том случае, когда Вы включаете звук, к примеру, баса, и слушаете его вне микса. Записали и послушали в стерео – роскошно. Записали в моно – бледно и плоско. И сразу спешим с выводами. Но не все так просто! И сейчас я попытаюсь разъяснить, где зарыта собака.

Моно и стерео с точки зрения физики

Начну с простых и логичных вещей. А именно – с физики звука .

Предположим, Вы хлопаете в ладоши. Каковым является источник звука – монофоническим или стереофоническим? Правильно, моно. Звук исходит из одной точки (или из одной зоны) и распространяется в пространстве в разные стороны. Далее он встречается с разными препятствиями, и, исходя из природы этих препятствий, либо частично ими поглощается, либо отражается от них.

Хлопая, Вы слышите этот звук Вашими ушами. Каковым является в этом случае приемник сигнала – монофоническим или стереофоническим? Правильно, стереофоническим. Точнее, бинауральным.

Бинауральность – способность человека или животного определять местонахождение источника звука посредством восприятия его двумя рецепторами – ушами. Если объект находится справа, то звук на долю секунды раньше доходит до правого уха, а затем до левого. Наш мозг мгновенно обрабатывает эту информацию, и мы имеем возможность локализовать источник сигнала. Кроме того, помимо непосредственно прямого звука, наши уши воспринимают и его отражения со всех сторон. И тут же выдает нам данные о том, находимся ли мы на открытой площадке, или в помещении, и если это помещение – то еще и о размерах этого помещения, и даже о том, к какой из стенок ближе находится источник сигнала.

Сумма всех отражений от всех поверхностей помещения создает пространственный эффект – реверберацию . Таким образом, можно сказать, что мы имеем дело с двумя составляющими – источником прямого сигнала и реверберацией.

Вернемся к нашему хлопку. Итак, хлопаем в моно, слышим в стерео. То же самое происходит с большинством музыкальных инструментов. Скрипка играет из одной небольшой зоны, а уши слушателя воспринимают ее звук вместе с акустикой концертного зала. Бас-бочка, малый барабан, томы или любые другие перкуссионные инструменты также издают звук локально, и только потом наш мозг интерпретирует суммарную звуковую информацию в объемную звуковую картину. Бас-гитара, подключенная к комбику, звучит из одной колонки, причем чаще всего даже имеющей всего один динамик. Но даже если динамиков несколько – они работают как единая система, занимающая чуть большее пространство, при этом оставаясь локальной. А уже наши уши воспринимают звук более широко, с учетом отражений.

В принципе, изложенного выше вполне достаточно, чтобы, подойдя к вопросу аналитически, понять, какие инструменты нужно записывать в моно, а какие нет. Тем не менее, я хотел бы еще немного углубиться в тему.

Причины неверных выводов

Вернемся к тому месту, где Вы условно попытались записать звук баса из синтезатора, и сделали вывод о том, что запись в стерео звучит лучше. Посмотрим, почему так получилось.

Во-первых, давайте проверим, включены ли в этот момент эффекты . Скорее всего – да. Почему это неправильно – я расскажу в ближайшем будущем в отдельной статье, а пока давайте примем за аксиому – при записи эффекты нужно отключать. Но если уж у Вас эффекты не были отключены, значит Вы слушали запись не только самого источника (бас), но и его отражений (реверберации). Сравните восприятие любого звука двумя ушами и одним закрытым ухом, закрыв второе! Что слышим? Звук более плоский, его сложно локализовать, понять, с какой стороны он звучит, и так далее.

Так и при записи – Вы записали только часть пространства, а остальную отрезали и выкинули. Естественно, такая запись будет восприниматься негативно. Так что, возвращаемся снова к этапу записи и отключаем эффекты.

Смотрим дальше. Вы при записи стерео использовали два канала, а при записи моно – один. А проверили ли Вы, как был панорамирован сигнал при записи моно? Для полноценной записи звука из одного выхода, Вам необходимо в меню этого пресета задать звучание без панорамы. То есть, свести панораму в одну точку – левый канал вправо, правый канал вправо. И брать звук из этого правого канала. А еще лучше – направить этот звук в . Естественно, если Вы этого не сделали – то Ваш монофонический сигнал записан неполноценно, и он будет звучать существенно тише, чем в стерео. А так уж устроен человек, особенно если он аранжировщик. То, что слышится тише – априори считается худшим. Естественно, это заблуждение.

Вот теперь сравниваем. У нас есть два чистых сигнала с выключенной обработкой. Один записан полноценным моно, другой стерео. Уверяю, если все сделано, как описано выше – Вы как минимум усомнитесь в том, что стереофоническая запись лучше.

Последствия неправильной записи

Конечно, сидя перед мониторами и сравнивая две записи, сделанные таким образом, можно все еще сохранить ощущение, что стерео звучит чуть более насыщенно. Однако оставлять большинство дорожек записанными в стерео может быть чревато негативными последствиями для Вашего итогового микса.

Ситуаций может быть две: либо Вы сами столкнетесь с трудностями при манипуляциях с панорамой при сведении, либо за Вас это сделает кто-то другой, когда будет воспроизводить Ваше творение.

Некачественное воспроизведение музыки

Начнем со второго. Как и когда Ваше стерео может воспроизводиться в моно? Самые банальные примеры – воспроизведение на радио (на многих радиостанциях стоит некачественное оборудование и трудятся неквалифицированные в области звука работники, так что Ваша запись легко может звучать в моно), или при трансляции на телевидении (поверьте, все еще немало народу имеют телевизоры, выдающие моно-сигнал; у многих к телевизору могут быть подключены внешние колонки, расставленные слишком далеко друг от друга; ну и неквалифицированных работников на ТВ также предостаточно).

Но могут быть и другие, непредвиденные случаи. Однажды, будучи на гастролях в Екатеринбурге, я с друзьями зашел в пельменную, поесть знаменитых уральских пельменей. Пельмени были замечательные, все остальное тоже прекрасно, и персонал очень дружелюбный. Но вот то, как там было организовано музыкальное оформление…

В общем, ситуация была такая. Сидим мы со звукорежиссером коллектива под одной колонкой, из которой играет музыка. В основном, наша русская попса. И что мы слышим? От песни к песне – то один инструмент вываливается, то другой. То бас пропадает вообще, то бочки не слышно, то голос звучит мутно и тихо. Я заинтересовался. Ведь даже если бы это была одна из двух колонок, работающих в стерео, там бы все равно нормально было слышно все основные инструменты и голос, а разница была бы только в объемности и в некоторых элементах звукового оформления.

Я стал ходить по залу ресторана и слушать звук в разных точках. И к удивлению обнаружил, что колонок в зале три. И из каждой из них звук играет по-разному. Зал был длинный, мы сидели в середине. Незнакомые с элементарными законами акустики работники ресторана расставили колонки таким образом: правый канал в самой глубокой точке ресторана, левый – около входа, а в середине поставили еще одну колонку, в которую завели два канала одновременно, то есть суммировали стерео в моно.

Как мы знаем, при суммировании возможны проблемы с фазой сигнала, если при сведении были допущены ошибки. Так вот, как раз здесь все было очевидно. Те записи, где был неслышен бас – имели звук баса, записанный в стерео. Где неслышна бочка – там в стерео записывались барабаны. Поэтому два сигнала, наложенные друг на друга в , давали пустоту, и микс слушался куцым и плоским.

Аналогичных ситуаций может быть море. Никогда не знаете, где и как будет играть Ваша музыка. Я рассказал только об одном примере. Но в очень многих клубах и ресторанах персонал вынужден проявлять изобретательность из-за жлобливости владельцев, не желающих приглашать специалистов для инсталляции звука. Результат – в лучшем случае Ваша музыка может расстроить слушателя, а в худшем – он ее и вообще не заметит, не услышав ничего интересного.

Стоит ли рисковать? Мне кажется, лучше заранее подстраховаться и работать с источниками грамотно, чтобы не зависеть от сомнительных кадров.

Проблемы при сведении

А теперь вернемся к проблемам, которые могут возникнуть непосредственно в ходе Вашей работы над сведением .

Во-первых, записывая все в стерео, Вы получаете огромное количество играющих каналов . Не буду говорить, что их будет вдвое больше, чем надо, ведь все-таки некоторые звуки можно и даже нужно записывать в стерео. Но процентов на 50-70 Вы точно перегрузите Вашу систему. А это значит, что если Вы работаете в ресурсозависимой среде – Вы получите гораздо более мыльный и мутный саунд, а если работаете в ресурсонезависимой – вполне можете выйти за пределы рабочей мощности, и Вам придется искать способы сокращать количество дорожек. Отличия ресурсозависимых и ресурсонезависимых систем подробно описаны в этой статье .

Во-вторых, чрезмерно большое количество стереофонических дорожек негативно отражается на плотности Вашего звукового полотна . Я уже писал про фазовые сложения, но это были сложения на стадии воспроизведения. А еще Вы можете столкнуться с проблемой фазы на стадии сведения. Два канала одного и того же сигнала при укладывании в микс могут начать «хорусить», местами проваливаться, создавая динамическую неровность, с которой сложно бороться. Этот эффект усугубится, когда Вы начнете добавлять в микс обработку. Она будет дополнительно наслаиваться на чистый сигнал, и создавать дополнительные проблемы.

В-третьих, монофонический сигнал гораздо проще локализовать в миксе . Вы просто задаете ему точное значение панорамы – к примеру, 30 процентов влево – и звук идет именно из этой точки. Гораздо сложнее, если Вам нужно осуществлять балансировку по панораме сразу двух каналов. Вы должны задать панорамную зону для данного инструмента, и чем более узкой будет эта зона, тем хуже будет звучание инструмента.

Пример. Вы записали сольный звук в стерео. И хотите, чтобы он звучал примерно на 30 процентов по панораме влево, сохраняя стереофоничность. Вам придется установить панораму левого канала на 35-40 процентов, а панораму правого – на 20-25 в ту же сторону. В итоге, Вы сужаете изначально записанное стерео (при этом вопрос – зачем тогда это вообще нужно?), получаете совсем иное звучание в сравнении с тем, что слышали при записи (ведь Вы слушали в полноценном стерео!), ну и, опять же, добро пожаловать к проблемам с противофазой (чем ближе два канала, тем острее ощущаются фазовые вычитания). Вам оно надо?

Ну и в-четвертых, стереофонический сигнал потребует больше сил, внимания и нервов для правильной обработки – будь то динамическая обработка, или пространственная. Если работаете в цифровой среде – потребуется вдвое больше ресурсов. Если в аналоговой – вдвое больше каналов (а в аналоге они обычно на счету), и плюс к тому надо более деликатно выверять посылы каждого канала на обработку. В общем – геморроя много, а преимущества сомнительны.

Как это все обстоит при записи в моно? Все гораздо проще. Никаких проблем с фазой. Никаких проблем с панорамированием. Очень просто работать с эффектами и с динамической обработкой. Да и еще ресурсы экономим. В общем – красота.

А теперь вернемся к истокам. Ведь наша задача – сделать звучание объемным и широким? Верно. Так вот, вспомним все, что я говорил в самом начале. Источник моно, приемник стерео.

Для того, чтобы провести параллели между хлопком в ладоши и ушами с одной стороны и записью синтезатора и финальным миксом с другой – обратимся к пространственной обработке. Помним, что реверберация при восприятии нашим слухом примешивается к источнику исходя из параметров помещения.

Это мы и будем делать с синтезатором – добавим к нему реверберацию и прочую обработку . И делать это будем не пропуская звук напрямую через процессор, а отправляя его в посыл на прибор и возвращая в микс в виде примеси. Ручки Aux Send на каждом канале посылают сигнал с этого канала на обработку, а ручки Aux Return задают уровень возвращаемого сигнала. Естественно, для этого процессор должен быть правильно подключен к пульту. Аналогично все делается и в цифровой среде, с единственной разницей, что обработку нужно будет предварительно сконфигурировать в параметрах Вашей системы.

Слушаем чистый сигнал, и регулируем ручками Aux количество подмешиваемой обработки. И слышим стерео !

Что записываем моно, а что стерео

А теперь я отдельно расскажу о том, какие инструменты следует писать только в моно, какие желательно оставлять в стерео, и какие можно варьировать по способу записи исходя из конкретной ситуации.

Моно . Обязательно пишем в моно основные барабаны (бочка, малый, хай-хет), перкуссию (томы, коу-белл, бонги, конго, и так далее, в том случае, если они записываются индивидуально, потреково), бас, любые синтезаторные лиды, басы, и прочее. Также в моно можно (и иногда нужно) писать звук фортепиано , если он выполняет второстепенную задачу в аранжировке. В большинстве случаев арпеджиаторы и пиццикатные синтетические секвенции тоже должны быть в моно (чаще всего на них при сведении применяется дилей, поэтому звучание будет более аккуратным при монофонической записи). В один канал записываются электромеханические пианино (Rhodes, Wurlitzer и так далее), электроорганы, звуки Clavinet и прочих инструментов, если запись производится в линию.

Стерео . Можно и иногда предпочтительно писать в стерео звук фортепиано (в том случае, если этот звук играет важную роль в ткани аранжировки), синтезаторные пэды и стрингс (за исключением тех случаев, когда стринг-машина изначально монофоническая). Также в стерео следует писать инструменты, в которых внутренняя обработка является неотъемлемой частью звука синтезатора (например, специфичный хорус). Часто бывает, что запись драм-машин или семплеров с загруженными звуками барабанов производится стереопарой, через основные выходы (в таких случаях к общему миксу просто примешиваются бочка и малый, записанные в моно).

В зависимости от ситуации , можно записывать в моно или стерео различные спецэффекты (FX), живые инструменты (к примеру, акустическую гитару можно записать одним микрофоном, а можно двумя), и так далее.

Для достижения стереофонического эффекта можно использовать распространенный способ записи – дабл-трек . К примеру, чаще всего таким способом записываются перегруженные гитары в рок-музыке, иногда широкие гитарные переборы. Также дабл-треком можно писать монофонические синтезаторы , значение которых для аранжировки велико. К примеру, что-то типа фуззов в нижней середине, в том же диапазоне, что и гитара с овердрайвом.

При этом, ритмичные гитарные пиццикато (когда гитара выполняет перкуссионную роль, как, например, в стилях фанк, фьюжн, иногда в поп-музыке) записываются в моно, и дабл-трек в этом случае не применяется. Панорамируется такой сигнал чаще всего куда-нибудь в одну сторону, при этом с другой стороны ритмическая пустота компенсируется каким-либо другим схожим звуком.

Для придания объемности басовому звуку к чистому сигналу можно подмешивать через Aux эффект хоруса. Главное с этим не переборщить, иначе бас теряет четкость и замыливается.

При записи живой бас-гитары иногда задействуется два канала – один канал записывает звук, снимаемый микрофоном с комбика, а другой – линейный выход предусилителя комбика. Это делается ни в коем случае не для достижения стереофонии. Исключительно для ужирнения монофонического сигнала. При записи таким способом оба канала сводятся по панораме в середине, и в обязательном порядке анализируется фаза. При необходимости (если возникает эффект флэнжера или ощутимые фазовые вычитания) задержка одного из каналов компенсируется движением всего региона, таким образом, чтобы фаза была полностью совмещена.

Экспериментируйте

Вот, в целом, и все, что необходимо знать о моно и стерео при записи инструментов. Все изложенное выше ни в коем случае не является панацеей или рекомендациями на все случаи жизни. И, конечно же, я охватил далеко не все возможные случаи и типы звуков. В зависимости от Вашего материала, Вы можете отклоняться в ту или иную сторону от этих рекомендаций. Кроме того, любой творческий человек ищет себя в экспериментах, желая найти собственное звучание и характер.

Самое главное – понять, что Вы не будете звучать супер-экспериментально, только лишь заменив все возможные моно-каналы на стерео. Скорее всего, это приведет к грязи, замыленности и к сложности на этапе сведения. Плюс ко всему, если Вы планируете отдавать свой материал на сведение в профессиональную студию – Вы наверняка узнаете о себе много нового от звукорежиссера, который будет заниматься Вашим проектом, принеся все дорожки в стерео.

С другой стороны, научившись грамотно работать в моно, Вы ощутите легкость на этапе сведения, простоту пространственной локализации различных инструментов. Баланс будет выстраиваться гораздо проще, а любой звукорежиссер похвалит за мудрый подход к аранжировке и будет Вас приводить в пример другим.

Очень скоро я постараюсь максимально подробно рассказать еще об одном важном вопросе, который очень интересует всех музыкантов, занимающихся сведением в домашних условиях. Он будет касаться применения внутренних эффектов синтезаторов на этапе записи. А именно – какие эффекты можно записывать вместе с самим звуком, а какие ни в коем случае нельзя.

Если такие темы Вам близки, Вы можете подписаться на обновления моего блога , и тогда новости о появлении новых полезных статей будут доставляться непосредственно Вам на почту.

Удачных экспериментов.

Фото Земфиры Комиссаровой

При перепечатывании ссылка на источник обязательна.

Здравствуйте дорогие читатели. Сегодня мы с вами рассмотрим не самый распространенный вопрос, но все же важный, особенно для меломанов. Итак, как же сделать из стерео звука - моно и на оборот из моно - стерео.

Недавно и я столкнулся с такой проблемой, когда скачал альбом из 30 композиций. Затем я залил их в MP3 плеер и когда нажал кнопку «Play», то был неприятно удивлен. Аудио постоянно «качалось» то в левый наушник, то в правый. Это слишком сильно раздражало. Не знаю, толи во время записи звуковых файлов произошла ошибка, толи какая-то другая причина. В общем, это уже не важно.

Первым делом я решил, что необходимо найти программу, которая сможет преобразовать стерео в моно. Но кроме этого, она еще должна это сделать сразу со всеми 30 треками, чтобы сохранить моё драгоценное время. А самое главное - она должна быть бесплатной.

Во время поиска такой универсальной программы я очень часто наталкивался на редактор звуковых дорожек - Audacity. Конечно же, при помощи Audacity можно сделать из стерео звука - моно, но для этого придется конвертировать каждый трек отдельно. Поэтому Audacity я сразу сказал нет.

И вот, после 30 минут безрезультатных поисков мне удалось все же найти желаемую программу - MP3 Quality Modifier. Она находится в свободном доступе (можно скачать бесплатно) и работает с аудио-файлами в пакетном режиме. Кстати, чтобы вы долго не искали где можно скачать эту программу, я решил выложить её вам. Качаем и пользуемся на здоровье.

Скачать бесплатно программу MP 3 Quality Modifier

(cкачиваний: 2828)

Первое, что мне понравилось в этой программе - русский интерфейс. Это очень удобно и значительно сократило время для изучения функционала. Также она не требует установки, то есть portable (запускается через exe файл и без проблем запускается на любом компьютере). Из-за этого я её перенес на и установил у себя на рабочем ноутбуке - вдруг понадобиться.

Теперь давайте перейдем непосредственно к рассмотрению принципа преобразования стерео звука в моно и наоборот (из моно в стерео).

Для начала разархивируйте скаченный архив в подходящее место на вашем жестком диске и запустите файл MP3QualityModifier.exe

Откроется непосредственно сама программа. Затем вам необходимо перенесите в неё папку с MP3 файлами или отдельными треками. Это можно сделать при помощи обычного перетаскивания мышью или используя кнопки «Добавление файлов » и «Добавление папки ».

Далее в разделе «Режим » (находится в самом низу программы) из выпадающего меню выберите «Мо n о ». Если же вы хотите преобразовать моно звук в стерео, то нужно выбрать из списка соответственно «Stereo ».

Теперь, если нужно, измените скорость (битрейк), частоту дискретизации и путь к папке, в которой будут сохраняться преобразованные аудио-файлы. Советую вам установить параметр качества звука такими, которые были указаны по умолчанию к трекам.

Также стоит обратить внимание на то, что например значение битрейка на разных треках может быть разным, а установить вам нужно одно для всех. В данном случае советую ставить максимальное значение из всех.

По окончанию всех настроек, чтобы начать процесс преобразования стерео звука в моно (или на оборот) нажмите кнопку «Образовать ».

Появится окно с таймлайном. Дождитесь окончания процесса конвертации.

Потом появится новое окошко, результирующее. Нажмите кнопку «ОК ».

На этому все. Наслаждайтесь получившимися треками.

Мы все слышали термин стерео, но что это такое? Что позволяет слушать музыку в стерео, объединяя два канала вместе и создавая звуковую сцену. Однако, когда у вас есть только один динамик, вы будете слушать в моно.

Что такое стерео?

Стерефонический звук, также известный как «стерео звук», является термином для создания звука. В случае стерео, это относится к двум направлениям, которые обычно называются «правыми» и «левыми».

Стерео означает, что вместо всего звука со всех треков в записи, воспроизводимой одновременно из одного источника, источник делится на два сигнала. Во время записи дорожки могут быть отрегулированы так, чтобы определенные треки воспроизводились только из одного или из двух источников, или обоих, или в любой комбинации источников, включая воспроизведение одного и того же трека на разных уровнях громкости через каждый канал («источник»). Основной целью стерео-записи является создание высокой точности, реалистичной звуковой сцены, которую нужно прослушивать с помощью .

Разница заключается в количестве используемых каналов (сигналов). Моно использует один, стерео использует более одного.

В монофоническом звуке используется один единственный канал. Его можно воспроизвести через несколько динамиков, но все динамики все еще воспроизводят одну и ту же копию сигнала.

В стереофоническом звуке используются больше каналов (обычно два). Вы можете использовать два разных канала и сделать один канал одним динамиком (акустикой), а второй канал — вторым громкоговорителем (который является наиболее распространенной стереофонической настройкой). Это для создания направленности, перспективы, пространства, сцены.

Ниже приведен пример использования двух колонок.

Моно

Стерео

С технической точки зрения, истинное стерео означает звукозапись и воспроизведение звука, которое использует стереографическую проекцию для кодирования относительных положений объектов и записанных событий- .

В общей стереофонической настройке двух каналов: влево и вправо, один канал отправляется на левый громкоговоритель, а другой канал отправляется в правый громкоговоритель. Теперь, контролируя, на какой канал вы посылаете сигнал, вы можете управлять положением звука. Вы услышите звуки, исходящие из разных направлений, в зависимости от того, на какой громкоговоритель вы посылаете сигнал, или в какой пропорции (вы можете отправить чуть больше на правую акустику, и звук будет расположен чуть правее). Звуки с равными пропорциями на обоих громкоговорителях будут поступать из центра.

Другими словами, стерео открывает уникальную возможность воспроизведения со звуковой локализацией.

Хотя мы используем термин «стерео» для обозначения многих вещей (например, стерео-картинка), на самом деле стерео относится к способу создания и прослушивания музыки. Для стереофонических сигналов требуется 2 динамика или 2 шт. акустики или наушники, чтобы воспроизводить их правильно, а для сигналов моно нужен только один динамик.

Когда было изобретено стерео?

Стерео было изобретено в 1930-х годах, но не получило широкого распространения аж до 1960-х годов. До этого все слушали в моно (один). Стерео — это действительно простой термин, но на самом деле он скрывает довольно много технического материала, чтобы оно работало .

Как сделать стерео звук?

По сути, стерео запись позволяет вам создавать 3D-виртуальную звуковую сцену в вашей комнате с двумя динамиками. Под 3D я имею в виду, хорошие колонки + не дешевая техника, на которых вы можете слышать певцов, или звуковые инструменты, расположенные вокруг динамиков, горизонтально и вертикально, и даже спереди или сзади.

Впрочем, большинство современных дешевых акустических систем просто представляют плоскую звуковую сцену (инструменты и вокал расположены горизонтально между динамиками), и это считается нормально, но если у вас есть хорошая акустика + хороший источник (внешний ЦАП) + хороший усилитель вы получаете превосходного качества звуковую сцену, вы начнете слышать полную 3D сцену.

Если есть только один динамик, то стереосигналы могут быть легко преобразованы в моно, чтобы воспроизводить их идеально, но без каких-либо особых аспектов позиционирования. И наоборот, если вы поместите монофонический сигнал в 2 динамика, то вы не получите стереосигнал, а только монофонический сигнал, но в два раза !

Эта трехмерная звуковая сцена выполняется в процессе записи, когда записывают музыку с информацией о уровне и фазе, а также записывая или добавляя реверберацию, чтобы дать ощущение глубины. Результаты сильно отличаются, но оркестровая работа регулярно записывается в стерео, с большим реализмом.

Всё сделано в стерео?

Люди слушают моно в основном. Это связано с тем, что нам сложно слушать набор стереодинамиков, акустики на ходу — стерео работает только если вы сидите и слушаете акустику или динамики с каждой стороны. Таким образом, большая часть музыки, которая играет в отелях, супермаркетах, телефонах, док-станциях, телевизорах, радио и т. д., преобразуется в/или фактически играет в моно.

Можете ли вы получить стереозвук из одного динамика?

На самом деле, нет. Есть довольно много динамиков в одной акустике, слушая которые вы думаете, что вы слушаете стерео, и могут действительно иметь в себе 2, 3, 4 динамика, но это не делает её стереосистемой! Как правило, хорошее моно звучит лучше, чем плохое стерео.

Чтобы создать стерео звуковую сцену, вам нужно услышать разные сигналы в каждом из двух ушей. Для этого вам требуется смесь прямого звука от динамика, и амплитуда, когерентный отраженный звук от стен комнаты, полов, потолка и т. д. Это может произойти только в том случае, если расстояние между громкоговорителями составляет, то же расстояние, что и динамики, акустика. Поэтому, если вы находитесь на некотором расстоянии, то и динамики (акустика) должны быть примерно на некотором расстоянии друг от друга. Компьютерные колонки к примеру, должны быть примерно на 50-60 см друг от друга и так .

Bluetooth стерео

Недавно чипы Bluetooth позволили производителям предложить стерео Bluetooth (CSR True Stereo) . Теперь их устанавливают не только на наушниках.

Bluetooth стерео хорошо работает для случайного прослушивания или для новичков, и не соответствует качественным звуковым стандартам Hi-Fi. Это связано с тем, что Bluetooth не может отправлять данные на два динамика одновременно, поэтому он отправляет данные одному громкоговорителю, которые затем повторно передает его на другой. Сетевой эффект заключается в том, что между звуком, идущим слева и справа, происходит задержка. Несмотря на небольшую задержку, эта задержка может повредить звуковой сцене, поэтому вы не получите .

Поскольку у нас есть два уха, на противоположных сторонах нашей головы, мы слышим звук из двух направлений. Чтобы записать этот стереозвук, используются два микрофона (по крайней мере). Ф актически, лучшая теоретическая позиция для этих двух микрофонов находится на расстоянии 180 градусов друг от друга — точно так же, как наши уши.

В ситуации, когда, скажем, играет группа, звук будет поступать из разных направлений, поэтому можно использовать несколько микрофонов, а положение в микшировании — панорамирование можно перемещать с помощью записывающего стола. Когда вы слушаете что-то в стерео с наушниками, вы можете себе представить, где играет пианист, внутри вашей головы.

С моно, нет ничего сложного. Звук в каждом ухе идентичен. Его можно записать всего одним микрофоном.

Идея возникла, когда кто-то прослушал записи, которые были сделаны с микрофоном в разных местах, и он понял, что два микрофона будут «слышать» два разных микса.

Лучший способ проверить, является ли запись стереофоническим, — это слышать аплодисменты. Это очень очевидно, моно или стерео.

Окружающий звук в кино продолжает эту идею. В основном он использует задержку, чтобы заставить звук появляться издалека, но он достигнут с использованием 7 различных положений для микрофонов и более, которые усиливаются с 7 различными усилителями и динамиками, установленными по комнате.

Если вы являетесь производителем, импортером, дистрибьютором или агентом в области воспроизведения звука и хотели бы связаться с нами, пожалуйста, свяжитесь со мной в

Человеческое стремление к объемам проявилось задолго до появления видеоэффектов 3D — в звуковой сфере. На заре звукозаписи, когда не было не только цифровой аппаратуры, но и даже магнитных лент, работа со стереозвуком уже была реальностью. Правда, до середины прошлого века она имела вид экспериментов, и широкое распространение стереосистемы начали получать только к шестидесятым годам. Сегодня стереозвук для абсолютного большинства потребителей представляется естественным благом, а монозвучание аудиотехники — редкостью и игрушкой для профессионалов.

Определение

Моно , или монофония, представляет собой одноканальную запись звука (и, соответственно, его воспроизведение).

Стерео , или стереофония — двухканальная (и более) запись и трансляция звука.

Сравнение

Чем отличается моно от стерео для обычного потребителя, пользователя аудиотехники или слушателя? В первую очередь пространственным отношением. Моно не дает возможности определить пространственное положение источника звука, стерео это позволяет. Все дело в особенности устройства человеческого слуха: уши наши, хоть и расположены на небольшом расстоянии друг от друга, звук воспринимают не одновременно. Если источник звука находится справа, то сначала его услышит правое ухо, а потом левое, причем для левого частота будет иной. Мозг полученную информацию обрабатывает, и мы можем определить на слух, откуда поступил сигнал.

Звук моно записывается в одну аудиодорожку и воспроизводится одним динамиком. При этом на восприятие его не влияет пространственное положение слушателя относительно источника звука. В принципе, подключить можно и множество колонок, однако в этом случае каждая будет транслировать звук абсолютно одинаково. Стереозвук записывается при помощи двух микрофонов в две и более дорожки, и разделение по каналам происходит на уровне частот, инструментов, голоса, шумовых и звуковых эффектов. К примеру, при прослушивании монозаписи интервью звук проезжающего мимо автомобиля будет воспринят наряду с голосом опрашиваемого, а в случае стереозаписи — как фон далекий или близкий. Для воспроизведения стереозвука требуется наличие как минимум пары колонок, а для достижения оптимального эффекта слушатель должен располагаться примерно по центру от обоих источников звука. Потому стереоколонки устанавливаются по обе стороны от монитора или телевизора.

К слову, трехмерность и объемность стереозвука — своего рода фикция. Две колонки на столе или наушники объемности звучанию не придают, так как служат источниками звука, четко определяемыми мозгом как “справа” и “слева”. Если число источников увеличить (знаменитый “суперсурраунд” — звук вокруг), то это будет означать всего лишь большее количество точек воспроизведения. Для получения трехмерного эффекта и получения реальной звуковой картины, к примеру, при просмотре фильма, звук должен разноситься еще и по вертикали.

Моносистемы на сегодняшний день стали редкостью, тогда как стерео в разных вариантах исполнения полностью захватило аудиорынок. Однако для профессионалов, работающих со звуком, нет и не может быть предпочтений: одноканальные записи используются в работе наравне с многоканальными. Считается, что моно объективнее в отношении источника звука, а стерео — в отношении звуковой картины.

Выводы сайт

- Моно — одноканальная запись звука, стерео – двухканальная.

- Для воспроизведения монозвука достаточно единственного динамика, стерео — как минимум двух.

- Стерео позволяет определять пространственное положение источника звука.

- Стерео дает звуковую картину, приближенную к реальной.

blackhack.ru ОК. Настройки, новости, игры.

blackhack.ru ОК. Настройки, новости, игры.