Классификация мер

Меры информации

Формы адекватности информации

Адекватность информации может выражаться в трех формах: семантической, синтаксической, прагматической.

Синтаксическая адекватность. Она отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов её представления, надежность и точность преобразования этих кодов и т. п. Информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, т.к. при этом не имеет значения смысловая сторона.

Семантическая (смысловая) адекватность. Эта форма определяет степень соответствия образа объекта и самого объекта. Семантический аспект предполагает учет смыслового содержания информации. На этом уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи. В информатике устанавливаются смысловые связи между кодами представления информации. Эта форма служит для формирования понятий и представлений, выявления смысла, содержания информации и ее обобщения.

Прагматическая (потребительская) адекватность отражает отношение информации и ее потребителя, соответствие информации цели управления, которая на ее основе реализуется. Прагматические свойства информации проявляются только при наличии единства информации (объекта), пользователя и цели управления. Прагматический аспект рассмотрения связан с ценностью, полезностью использования информации при выработке потребителем решения для достижения своей цели.

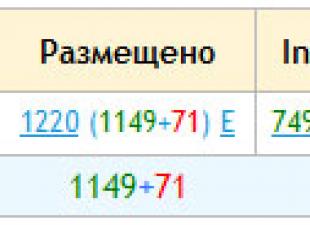

Для измерения информации вводятся два параметра: количество информации I и объем данных V. Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности. Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Объем данных V д в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

- в двоичной системе счисления единица измерения - бит (bit - binary digit - двоичный разряд);

- в десятичной системе счисления единица измерения - дит (десятичный разряд).

Рис. 2.1. Меры информации

Количество информации I на синтаксическом уровне невозможно определить без рассмотрения понятия неопределенности состояния системы (энтропии системы). Действительно, получение информации о какой-либо системе всегда связано с изменением степени неосведомленности получателя о состоянии этой системы. Рассмотрим это понятие.

Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе a. Мерой его неосведомленности о системе является функция H(a), которая в то же время служит и мерой неопределенности состояния системы.

После получения некоторого сообщения b получатель приобрел некоторую дополнительную информацию I b (a), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения b) неопределенность состояния системы стала H b (a).

Тогда количество информации I b (a) о системе, полученной в сообщении b, определится как

I b (a) = H(a)-H b (a),

т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Если конечная неопределенность системы H b (a) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации I b (a) = H(a). Иными словами, энтропия системы H(a) может рассматриваться как мера недостающей информации.

Энтропия системы H(a), имеющая N возможных состояний, согласно формуле Шеннона, равна

![]() ,

,

где P i - вероятность того, что система находится в i-м состоянии.

Для случая, когда все состояния системы равновероятны, т.е. их вероятности равны P i = , ее энтропия определяется соотношением

![]() .

.

Часто информация кодируется числовыми кодами в той или иной системе счисления, особенно это актуально при представлении информации в компьютере. Естественно, что одно и то же количество разрядов в разных системах счисления может передать разное число состояний отображаемого объекта, что можно представить в виде соотношения

где N - число всевозможных отображаемых состояний;

m - основание системы счисления (разнообразие символов, применяемых в алфавите);

n - число разрядов (символов) в сообщении.

Наиболее часто используются двоичные и десятичные логарифмы. Единицами измерения в этих случаях будут соответственно бит и дит.

Коэффициент (степень) информативности (лаконичность) сообщения определяется отношением количества информации к объему данных, т.е.

Y=1/V д, причем 0 С увеличением Y уменьшаются объемы работы по преобразованию информации (данных в системе). Поэтому стремятся к повышению информативности, для чего разрабатываются специальные методы оптимального кодирования информации. Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус

пользователя. Тезаурус

- это совокупность сведений, которыми располагает пользователь или система. В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя S p изменяется количество семантической информации I c , воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер такой зависимости показан на рис. 2.2. Рассмотрим два предельных случая, когда количество семантической информации I c Максимальное количество семантической информации I c потребитель приобретает при согласовании ее смыслового содержания S со своим тезаурусом S p (S p = S p opt), когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения. Следовательно, количество семантической информации в сообщении, количество новых знаний, получаемых пользователем, является величиной относительной. Одно и то же сообщение может иметь смысловое содержание для компетентного пользователя и быть бессмысленным (семантический шум) для пользователя некомпетентного. При оценке семантического (содержательного) аспекта информации необходимо стремиться к согласованию величин S и S p . Относительной мерой количества семантической информации может служить коэффициент содержательности C, который определяется как отношение количества семантической информации к ее объему: Информационное взаимодействие. Способы передачи информации. Классификация информации.

Понятие информации. Свойства информации. Формы представления информации.

Информация (от лат. informatio - «разъяснение, изложение, осведомлённость») - сведения о чём-либо, независимо от формы их представления. Информацию можно разделить на виды по различным критериям: по способу восприятия: Визуальная - воспринимаемая органами зрения. Аудиальная - воспринимаемая органами слуха. Тактильная - воспринимаемая тактильными рецепторами. Обонятельная - воспринимаемая обонятельными рецепторами. Вкусовая - воспринимаемая вкусовыми рецепторами. по форме представления: Текстовая - передаваемая в виде символов, предназначенных обозначать лексемы языка. Числовая - в виде цифр и знаков, обозначающих математические действия. Графическая - в виде изображений, предметов, графиков. Звуковая - устная или в виде записи и передачи лексем языка аудиальным путём. по назначению: Массовая - содержит тривиальные сведения и оперирует набором понятий, понятным большей части социума. Специальная - содержит специфический набор понятий, при использовании происходит передача сведений, которые могут быть не понятны основной массе социума, но необходимы и понятны в рамках узкой социальной группы, где используется данная информация. Секретная - передаваемая узкому кругу лиц и по закрытым (защищённым) каналам. Личная (приватная) - набор сведений о какой-либо личности, определяющий социальное положение и типы социальных взаимодействий внутри популяции. по значению: Актуальная - информация, ценная в данный момент времени. Достоверная - информация, полученная без искажений. Понятная - информация, выраженная на языке, понятном тому, кому она предназначена. Полная - информация, достаточная для принятия правильного решения или понимания. Полезная - полезность информации определяется субъектом, получившим информацию в зависимости от объёма возможностей её использования. по истинности: истинная В информатике предметом изучения информации являются именно данные: методы их создания, хранения, обработки и передачи. Передачей информации называется процесс её пространственного переноса от источника к получателю (адресату). Передавать и получать информацию человек научился даже раньше, чем хранить её. Речь является способом передачи, который использовали наши далекие предки в непосредственном контакте (разговоре) - ею мы пользуемся и сейчас. Для передачи информации на большие расстояния необходимо использовать значительно более сложные информационные процессы. Для осуществления такого процесса информация должна быть некоторым образом оформлена (представлена). Для представления информации используются различные знаковые системы - наборы заранее оговоренных смысловых символов: предметов, картинок, написанных или напечатанных слов естественного языка. Представленная с их помощью семантическая информация о каком-либо объекте, явлении или процессе называется сообщением. Очевидно, что для передачи сообщения на расстояние информация должна быть перенесена на какой-либо мобильный носитель. Носители могут перемещаться в пространстве с помощью транспортных средств, как это происходит с письмами, посылаемыми по почте. Такой способ обеспечивает полную достоверность передачи информации, поскольку адресат получает оригинал сообщения, однако требует значительного времени для передачи. С середины XIX века получили распространение способы передачи информации, использующие естественно распространяющийся носитель информации - электромагнитные колебания (электрические колебания, радиоволны, свет). Устройства, реализующие процесс передачи данных, образуют системы связи. В зависимости от способа представления информации системы связи можно подразделять на знаковые (телеграф, телефакс), звуковые (телефон), видео и комбинированные системы (телевидение). Наиболее развитой системой связи в наше время является Интернет. Единицы измерения информации служат для измерения различных характеристик, связанных с информацией. Чаще всего измерение информации касается измерения ёмкости компьютерной памяти (запоминающих устройств) и измерения объёма данных, передаваемых по цифровым каналам связи. Реже измеряется количество информации. Бит (англ. binary digit - двоичное число; также игра слов: англ. bit - кусочек, частица) - единица измерения количества информации, равная одному разряду в двоичной системе счисления. Обозначается по ГОСТ 8.417-2002 Клод Шэннон в 1948 г предложил использовать слово bit для обозначения наименьшей единицы информации: Бит - это двоичный логарифм вероятности равновероятных событий или сумма произведений вероятности на двоичный логарифм вероятности при равновероятных событиях; см. информационная энтропия. Бит - базовая единица измерения количества информации, равная количеству информации, содержащемуся в опыте, имеющем два равновероятных исхода; см. информационная энтропия. Это тождественно количеству информации в ответе на вопрос, допускающий ответы «да» либо «нет» и никакого другого (то есть такое количество информации, которое позволяет однозначно ответить на поставленный вопрос). Синтаксическая мера информации

Возникновение информологии как науки можно отнести к концу 50-х годов нашего столетия, когда американским инженером Р. Хартли была сделана попытка ввести количественную меру информации, передаваемой по каналам связи. Рассмотрим простую игровую ситуацию. До получения сообщения о результате подбрасывания монеты человек находится в состоянии неопределенности относительно исхода очередного броска. Сообщение партнера дает информацию, снимающее эту неопределенность. Заметим, что число возможных исходов в описанной ситуации равно 2, они равноправны (равновероятны) и каждый раз передаваемая информация полностью снимала возникавшую неопределенность. Хартли принял «количество информации», передаваемое по каналу связи относительно двух равноправных исходов и снимающее неопределенность путем оказания на один из них, за единицу информации, получившую название «бит». Семантическая мера информации

Новый этап теоретического расширения понятия информации связан с кибернетикой - наукой об управлении и связи в живых организмах, обществе и машинах. Оставаясь на позициях шенноновского подхода, кибернетика формулирует принцип единства информации и управления, который особенно важен для анализа сути процессов, протекающих в самоуправляющихся, самоорганизующихся биологических и социальных системах. Развитая в работах Н. Винера концепция предполагает, что процесс управления в упомянутых системах является процессом переработки (преобразования) некоторым центральным устройством информации, получаемой от источников первичной информации (сенсорных рецепторов) и передачи ее в те участки системы, где она воспринимается ее элементами как приказ для выполнения того или иного действия. По совершении самого действия сенсорные рецепторы готовы к передаче информации об изменившейся ситуации для выполнения нового цикла управления. Так организуется циклический алгоритм (последовательность действий) управления и циркуляции информации в системе. При этом важно, что главную роль играет здесь содержание информации, передаваемой рецепторами и центральным устройством. Информация, по Винеру - это «обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств». Прагматическая мера информации

В прагматических концепциях информации этот аспект является центральным, что приводит к необходимости учитывать ценность, полезность, эффективность, экономичность информации, т.е. те ее качества, которые определяющим образом влияют на поведение самоорганизующихся, самоуправляющихся, целенаправленных кибернетических систем (биологических, социальных, человеко-машинных). Одним из ярких представителей прагматических теорий информации является поведенческая модель коммуникации - бихевиористская модель Акоффа-Майлса. Исходным в этой модели является целевая устремленность получателя информации на решение конкретной проблемы. Получатель находится в «целеустремленном состоянии», если он стремится к чему-нибудь и имеет альтернативные пути неодинаковой эффективности для достижения цели. Сообщение, переданное получателю иформативно, если оно изменяет его «целеустремленное состояние». Так как «целеустремленное состояние» характеризуется последовательностью возможных действий (альтернатив), эффективностью действия и значимостью результата, то передаваемое получателю сообщение может оказывать воздействие на все три компонента в различной степени. В соответствии с этим передаваемая информация различается по типам на «информирующую», «инструктирующую» и «мотивирующую». Таким образом, для получателя прагматическая ценность сообщения состоит в том, что оно позволяет ему наметить стратегию поведения при достижении цели построением ответов на вопросы: что, как и почему делать на каждом очередном шаге? Для каждого типа информации бихевиористская модель предлагает свою меру, а общая прагматическая ценность информации определяется как функция разности этих количеств в «целеустремленном состоянии» до и после его изменения на новое «целеустремленное состояние». Синтаксическая мера информации

В качестве синтаксической меры количество информации представляет объем данных. Объем данных V d

в сообщении «в» измеряется количестве символов (разрядов) в этом сообщении. Как мы упоминали, в двоичной системе счисления единица измерения - бит. На практике наряду с этой «самой мелкой» единицей измерения данных чаще применяется более крупная единица - байт, равная 8 бит

. Для удобства в качестве измерителей используются кило- (10 3), мега- (10 6), гига- (10 9) и тера- (10 12) байты и т.д. В знакомых всем байтах измеряется объем кратких письменных сообщений, толстых книг, музыкальных произведений, изображений, а также программных продуктов. Понятно, что эта мера никак не может характеризовать того, что и зачем несут эти единицы информации. Измерять в килобайтах роман Л.Н. Толстого «Война и мир» полезно, например, чтобы понять, сможет ли он разместиться на свободном месте твердого диска. Это столь же полезно, как измерять размер книги - ее высоту, толщину и ширину, чтобы оценить, поместится ли она на книжной полке, или взвешивать ее на предмет того, выдержит ли портфель совокупную тяжесть Итак. одной синтаксической меры информации явно недостаточно для характеристики сообщения: в нашем примере с погодой в последнем случае сообщение приятеля содержало ненулевой объем данных, но в нем не было нужной нам информации. Заключение о полезности информации следует из рассмотрения содержания сообщения. Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, введем понятие «тезаурус получателя информации». Тезаурус - это совокупность сведений и связей между ними, которыми располагает получатель информации.

Можно сказать, что тезаурус - это накопленные знания получателя. В очень простом случае, когда получателем является техническое устройство - персональный компьютер, тезаурус формируется «вооружением» компьютера - заложенными в него программами и устройствами, позволяющими принимать, обрабатывать и представлять текстовые сообщения на разных языках, использующих разные алфавиты, шрифты, а также аудио- и видеоинформацию из локальной или всемирной сети. Если компьютер не снабжен сетевой картой, нельзя ожидать получения на него сообщений от других пользователей сети ни в каком виде. Отсутствие драйверов с русскими шрифтами не позволит работать с сообщениями на русском языке и т.д. Если получателем является человек, его тезаурус - это тоже своеобразное интеллектуальное вооружение человека, арсенал его знаний. Он также образует своеобразный фильтр для поступающих сообщений. Поступившее сообщение обрабатывается с использованием имеющихся знаний с целью получения информации. Если тезаурус очень богат, то арсенал знаний глубок и многообразен, он позволит извлекать информацию из практически любого сообщения. Маленький тезаурус, содержащий скудный багаж знаний, может стать препятствием для понимания сообщений, требующих лучшей подготовки. Заметим, однако, что одного понимания сообщения для влияния на принятие решения мало - надо, чтобы в нем содержалась нужная для этого информация, которой нет в нашем тезаурусе и которую мы в него хотим включить. В случае с погодой в нашем тезаурусе не было последней, «актуальной» информации о погоде в районе университета. Если полученное сообщение изменяет наш тезаурус, может измениться и выбор решения. Такое изменение тезауруса и служит семантической мерой количества информации своеобразной мерой полезности полученного сообщения. Формально количество семантической информации I s ,

включаемой в дальнейшем в тезаурус, определяется соотношением тезауруса получателя S i

, и содержания передаваемой в сообщении «в» информации S.

Графический вид этой зависимости показан на рис.1. Рассмотрим случаи, когда количество семантической информации I s

равно или близко к нулю: При S i

= 0 получатель не воспринимает поступающую информацию; При 0 < S i

< S 0 получатель воспринимает, но не понимает поступившую в сообщении информацию; При S i

-» ∞получатель имеет исчерпывающие знания и поступающая информация не может пополнить его тезауруса. Рис. Зависимость количества семантической информации от тезаурса получателя

При тезаурусе S i

> S 0

количество семантической информации I s

, получаемое из вложенной сообщение β

информации S

вначале быстро растет

с ростом собственного тезауруса получателя, а затем - начиная с некоторого значения S i - падает

. Падение количества полезной для получателя информации происходит оттого, что багаж знаний получателя стал достаточно солидным и удивить его чем-то новым становится все труднее. Это можно проиллюстрировать на примере студентов, изучающих экономическую информатику и читающих материалы сайтов по корпоративным ИС.

Вначале при формировании первых знаний об информационных системах чтение мало что дает - много непонятных терминов, аббревиатур, даже заголовки не все понятны. Настойчивость в чтении книг, посещение лекций и семинаров, общение с профессионалами помогают пополнить тезаурус. Со временем чтение материалов сайта становится приятным и полезным, а к концу профессиональной карьеры - после написания многих статей и книг - получение новых полезных сведений с популярного сайта будет случаться намного реже. Можно говорить об оптимальном для данной информации S

тезаурусе получателя, при котором им будет получена максимальная информация Is, а также об оптимальной информации в сообщении «в» для данного тезауруса Sj.

В нашем примере, когда получателем является компьютер, оптимальный тезаурус означает, что его аппаратная часть и установленное программное обеспечение воспринимают и правильно интерпретируют для пользователя все содержащиеся в сообщении «в» символы, передающие смысл информации S.

Если в сообщении есть знаки, которые не соответствуют содержимому тезауруса, часть информации будет утрачена и величина I s

уменьшится. С другой стороны, если мы знаем, что получатель не имеет возможности получать тексты на русском (его компьютер не имеет нужных драйверов), а иностранных языков, на которых наше сообщение может быть послано, ни он, ни мы не изучали, для передачи необходимой информации мы можем прибегнуть к транслитерации - написанию русских текстов с использованием букв иностранного алфавита, хорошо воспринимаемого компьютером получателя. Так мы приведем в соответствие нашу информацию с имеющимся в распоряжении получателя тезаурусом компьютера. Сообщение будет выглядеть некрасиво, но всю необходимую информацию получателю удастся прочитать. Таким образом, максимальное количество семантической информации Is из сообщения β

получатель приобретает при согласовании ее смыслового содержания S c

тезаурусом Si,

(при Si

= Sj opt).

Информация из одного и того же сообщения может иметь смысловое содержание для компетентного пользователя и быть бессмысленной для пользователя некомпетентного. Количество семантической информации в сообщении, получаемом пользователем, является величиной индивидуальной, персонифицированной - в отличие от синтаксической информации. Однако измеряется семантическая информация так же, как синтаксическая, - в битах и байтах. Относительной мерой количества семантической информации служит коэффициент содержательности С, который определяется как отношение количества семантической информации к ее объему данных V d ,

содержащихся в сообщении β:

С = Is / Vd

Лекция 2 по дисциплине «Информатика и ИКТ»

Количество и качество информации

Уровни проблем передачи информации

При реализации информационных процессов всегда происходит перенос информации в пространстве и времени от источника информации к приемнику (получателю) с помощью сигналов. Сигнал

- физический процесс (явление), несущий сообщение (информацию) о событии или состоянии объекта наблюдения. Сообщение

-

форма представления информации в виде совокупности знаков (символов), используемая для передачи. Сообщение как совокупность знаков с точки зрения семиотики - науки, занимающейся исследованием свойств знаков и знаковых систем, - может изучаться на трех уровнях: 1) синтаксическом,

где рассматриваются внутренние свойства сообщений, т. е. отношения между знаками, отражающие структуру данной знаковой системы. 2) семантическом,

где анализируются отношения между знаками и обозначаемыми ими предметами, действиями, качествами, т. е. смысловое содержание сообщения, его отношение к источнику информации; 3) прагматическом,

где рассматриваются отношения между сообщением и получателем, т. е. потребительское содержание сообщения, его отношение к получателю. Проблемы синтаксического уровня

касаются создания теоретических основ построения информационных систем. На этом уровне рассматривают проблемы доставки получателю сообщений как совокупности знаков, учитывая при этом тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации, надежность и точность преобразования этих кодов и т. п., полностью абстрагируясь от смыслового содержания сообщений и их целевого предназначения. На этом уровне информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, так как смысловая сторона при этом не имеет значения. Проблемы семантического уровня

связаны с формализацией и учетом смысла передаваемой информации, определения степени соответствия образа объекта и самого объекта. На данном уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи, формируются понятия и представления, выявляется смысл, содержание информации, осуществляется ее обобщение. На прагматическом уровне

интересуют последствия от получения и использования данной информации потребителем. Проблемы этого уровня связаны с определением ценности и полезности использования информации при выработке потребителем решения для достижения своей цели. Основная сложность здесь состоит в том, что ценность, полезность информации может быть совершенно различной для различных получателей и, кроме того, она зависит от ряда факторов, таких, например, как своевременность ее доставки и использования. Меры информации

Меры информации синтаксического уровня

Для измерения информации на синтаксическом уровне вводятся два параметра: объем информации (данных) – V Д

(объемный подход) и количество информации - I

(энтропийный подход). Объем информации V Д.

При реализации информационных процессов информация передается в виде сообщения, представляющего собой совокупность символов какого-либо алфавита. Если количество информации, содержащейся в сообщении из одного символа, принять за единицу, тообъем информации (данных) V Д

в любом другом сообщении будет равен количеству символов (разрядов) в этом сообщении. Так, в десятичной системе счисления один разряд имеет вес, равный 10, и соответственно единицей измерения информации будет дит (десятичный разряд). В этом случае сообщение в виде n

V Д

= п

дит. Например, четырехразрядное число 2003 имеет объем данных V Д =

4 дит. В двоичной системе счисления один разряд имеет вес, равный 2, и соответственно единицей измерения информации будет бит (bit (binary digit)

- двоичный разряд). В этом случае сообщение в виде n

-разрядного числа имеет объем данных V Д = п

бит. Например, восьмиразрядный двоичный код 11001011 имеет объем данных V Д

= 8 бит. В современной вычислительной технике наряду с минимальной единицей измерения данных бит широко используется укрупненная единица измерения байт, равная 8 бит. При работе с большими объемами информации для подсчета ее количества применяют более крупные единицы измерения, такие как килобайт (кбайт), мегабайт (Мбайт), гигабайт (Гбайт), терабайт (Тбайт): 1 кбайт = 1024 байт = 2 10 байт; 1 Мбайт = 1024 кбайт = 2 20 байт = 1 048 576 байт; 1 Гбайт = 1024 Мбайт = 2 30 байт = 1 073 741 824 байт; . 1 Тбайт = 1024 Гбайт = 2 40 байт = 1 099 511 627 776 байт. Количество информации I (энтропийный подход).

В теории информации и кодирования принят энтропийный подход к измерению информации. Этот подход основан на том, что факт получения информации всегда связан с уменьшением разнообразия или неопределенности (энтропии) системы. Исходя из этого количество информации в сообщении определяется как мера уменьшения неопределенности состояния данной системы после получения сообщения. Как только наблюдатель выявил что-нибудь в физической системе, энтропия системы снизилась, так как для наблюдателя система стала более упорядоченной. Таким образом, при энтропийном подходе под информацией понимается количественная величина исчезнувшей в ходе какого-либо процесса (испытания, измерения и т. д.) неопределенности. При этом в качестве меры неопределенности вводится энтропия Н,

и количество информации равно: где H apr

- априорная энтропия о состоянии исследуемой системы; H aps

- апостериорная энтропия. Апостериори

- происходящее из опыта (испытания, измерения). Априори

- понятие, характеризующее знание, предшествующее опыту (испытанию), и независимое от него. В случае, когда в ходе испытания имевшаяся неопределенность снята (получен конкретный результат, т. е. H aps

= 0), количество полученной информации совпадает с первоначальной энтропией Рассмотрим в качестве исследуемой системы дискретный источник информации (источник дискретных сообщений), под которым будем понимать физическую систему, имеющую конечное множество возможных состояний. Это множество А

= {a

1, a

2 , ..., а п }

состояний системы в теории информации называют абстрактным алфавитом или алфавитом источника сообщений. Отдельные состояния а 1 , а 2 ,..., а„

называют буквами или символами алфавита. Такая система может в каждый момент времени случайным образом принять одно из конечных множеств возможных состояний а i .

Поскольку одни состояния выбираются источником чаще, а другие реже, то в общем случае он характеризуется ансамблем А,

т. е. полной совокупностью состояний с вероятностями их появления, составляющими в сумме единицу: Введем меру неопределенности выбора состояния источника. Ее можно рассматривать и как меру количества информации, получаемой при полном устранении неопределенности относительно равновероятных состояний источника. Тогда при N = 1

получаем Н(А)

= 0. Указанная мера была предложена американским ученым Р. Хартли в 1928 г. Основание логарифма в формуле (2.3) не имеет принципиального значения и определяет только масштаб или единицу измерения В зависимости от основания логарифма применяют следующие единицы измерения. 1. Биты - при этом основание логарифма равно 2: 2. Ниты - при этом основание логарифма равно е:

3. Диты - при этом основание логарифма равно 10: В информатике в качестве меры неопределенности обычно используют формулу (2.4). При этом единица неопределенности называется двоичной единицей, или битом, и представляет собой неопределенность выбора из двух равновероятных событий. Формулу (2.4) можно получить эмпирически: для снятия неопределенности в ситуации из двух равновероятных событий необходим один опыт и соответственно один бит информации, при неопределенности, состоящей из четырех равновероятных событий, достаточно 2 бит информации, чтобы угадать искомый факт. Для определения карты из колоды, состоящей из 32 карт, достаточно 5 бит информации, т. е достаточно задать пять вопросов с ответами «да» или «нет», чтобы определить искомую карту. Предложенная мера позволяет решать определенные практические задачи, когда все возможные состояния источника информации имеют одинаковую вероятность. В общем случае степень неопределенности реализации состояния источника информации зависит не только от числа состояний, но и от вероятностей этих состояний. Если источник информации имеет, например, два возможных состояния с вероятностями 0,99 и 0,01, то неопределенность выбора у него значительно меньше, чем у источника, имеющего два равновероятных состояния, так как в этом случае результат практически предрешен (реализация состояния, вероятность которого равна 0,99). Американский ученый К. Шеннон обобщил понятие меры неопределенности выбора H

на случай, когда H

зависит не только от числа состояний, но и от вероятностей этих состояний (вероятностей р i

выбора символов а i

, алфавита A). Эту меру, представляющую собой неопределенность, приходящуюся в среднем на одно состояние, называют энтропией дискретного источника информации:

Если снова ориентироваться на измерение неопределенности в двоичных единицах, то основание логарифма следует принять равным двум: При равновероятных выборах вероятность p i =1/N

формула (2.6) преобразуется в формулу Р. Хартли (2.3): Предложенная мера была названа энтропией не случайно. Дело в том, что формальная структура выражения (2.5) совпадает с энтропией физической системы, определенной ранее Больцманом. Используя формулы (2.4) и (2.6), можно определить избыточность D

алфавита источника сообщений А,

которая показывает, насколько рационально применяются символы данного алфавита: где Н max (А) -

максимально возможная энтропия, определяемая по формуле (2.4); Н(А) -

энтропия источника, определяемая по формуле (2.6). Суть данной меры заключается в том, что при равновероятном выборе ту же информационную нагрузку на знак можно обеспечить, используя алфавит меньшего объема, чем в случае с неравновероятным выбором. Единицы количества

информации, определяемые в рамках

вероятностного и объемного подходов,

представляют собой разновидности

синтаксической меры информации,

используемой при наиболее общем подходе,

когда предметом рассмотрения является

не только информация в узком смысле

(например, обрабатываемая компьютером),

но все ее виды, включая социальную. Синтаксическая

мера

оперирует

с обезличенной информацией, не выражающей

смыслового отношения к объекту. Объем

данных в информационном сообщении

измеряется количеством символов

(разрядов). В различных системах счисления

разряды имеют различный вес, соответственно

меняются единицы измерения данных.

Примерами могут служить бит, нат, трит,

дит. В рамках вероятностного подхода

синтаксическая мера количества информации

определяется степенью изменения

неопределенности состояния системы, в

рамках объемного подхода характеризует

объем информации. Семантическая

мера

используется для характеристики

информации с точки зрения ее смысла.

Семантический анализ дает возможность

раскрыть содержание информации и

показать отношения между смысловыми

значениями составляющих ее элементов.

В сочетании с понятием «тезаурус»

семантическая мера называется тезаурусной

мерой

информации. Тезаурусная мера была

предложена Ю.И.Шнейдером и получила

широкое распространение. Тезаурус

– это совокупность сведений, которыми

располагает пользователь или система.

Другое определение, не противоречащее

первому: тезаурус – полнота

систематизированного набора данных о

предмете информации. В ходе информационного

процесса в зависимости от соотношений

между смысловым содержанием информации

и тезаурусом пользователя изменяется

количество семантической информации,

воспринимаемой пользователем и включаемой

им в дальнейшем в свой тезаурус.

Максимальное количество семантической

информации пользователь получает, когда

информация ему понятна и несет ранее

неизвестные ему (отсутствующие в

тезаурусе) сведения. Приобретенное в

ходе информационного процесса количество

семантической информации является

величиной относительной, так как одно

и то же сообщение может иметь смысловое

содержание для компетентного пользователя

и быть бессмысленным (семантический

шум) для некомпетентного. Мерой

семантической информации может служить

коэффициент содержательности, определяемый

как отношение количества семантической

информации к общему ее объему. Прагматическая

мера

характеризует полезность (ценность)

информации для достижения пользователем

поставленной цели. Эта мера также

является относительной величиной,

зависящей от конкретных потребностей

пользователя и условий протекания

информационного процесса. В технической

системе прагматические свойства

информации определяют возможность

улучшения качества функционирования

системы. Формы

представления информации в ЭВМ. Системы

счисления В физической основе

работы вычислительной техники лежит

генерация, обработка и передача

электрических сигналов. Электрические

сигналы разделяют на аналоговые

(непрерывные) и цифровые

(дискретные). В вычислительной технике

применяют цифровые сигналы. Каждому

уровню напряжения (тока) ставят в

соответствие определённую цифру.

Соотнесение параметров электрического

сигнала с цифрами отражает связь между

техникой и математикой. Современные

ЭВМ базируются на двоичной системе

счисления, в которой имеются только две

цифры – 0 и 1. Выбор в пользу этой системы

обусловлен тем, что технически реализовать

её проще, чем привычную для человека

десятичную систему счисления. Основной элемент

электроники ЭВМ – транзистор, работающий

в ключевом

режиме

. В

этом режиме транзистор в зависимости

от приложенного к нему напряжения

реализует по принципу ключа два логических

состояния: открыт ‑ закрыт или

включён ‑ выключен. Два этих

состояния сопоставляют 0 и 1 двоичной

системы счисления - тем математическим

объектам, с помощью которых кодируется

любая информация, обрабатываемая

компьютером. На уровне характеристик

электрического сигнала «нулю» может,

например, соответствовать напряжение

минус 5 вольт, а «единице» - плюс 5

вольт. Или – 15 В и + 15 В.

Абсолютные значения напряжений, которым

сопоставлены логические состояния 0 и

1, для программной обработки информации

несущественны и определяются оптимальными

условиями функционирования электронных

плат. В устройствах хранения данных

информационные «нули» и «единицы» могут

быть реализованы иначе: например, на

магнитном диске состояниям 0 и 1

соответствуют разные направления

вектора намагниченности; в накопителях

Flash

– отсутствие или наличие электрического

заряда в данной микроскопической области

вещества; в микросхемах ОЗУ – незаряженный

или заряженный конденсатор. Итак, внутреннее

представление любой информации в

компьютере является двоичным. В

программировании также используются

восьмеричная и шестнадцатеричная

системы счисления. Кроме того, поскольку

пользователем компьютера является

человек, важна связь упомянутых систем

счисления с десятичной. Система счисления

– принятый способ записи чисел –

характеризуется количеством цифр, с

помощью которых можно выразить любое

число. Все системы счисления можно

разделить на два класса: позиционные

и непозиционные

.

Позиционные системы счисления – те, в

которых вес цифр зависит от их

местоположения в записи числа. Количество

цифр в позиционной системе называется

основанием

системы счисления

.

Ниже в одном блоке собраны важные

определения, относящиеся к системам

счисления. Цифры

– символы, используемые в записи числа

и составляющие некоторый алфавит. Число

– некоторая величина, которая складывается

из цифр по определённым правилам. Система

счисления

– способ записи чисел с помощью цифр. Позиционная

система счисления

– система счисления, в которой вес цифры

зависит от ее местоположения в записи. Разряд

– позиция цифры в числе. Основание

– количество цифр, используемых для

записи чисел. В компьютерах

используются позиционные системы

счисления. Системы

счисления, получившие

наибольшее применение в вычислительной

технике Основание Система счисления двоичная восьмеричная 0,

1, 2, 3, 4, 5, 6, 7 десятичная 0,

1, 2, 3, 4, 5, 6, 7, 8, 9 шестнадцатеричная 0,

1, 2, 3, 4, 5, 6, 7, 8, 9, A,

B, C, D, E, F Примером непозиционной

системы счисления является римская. В

этой системе используется 7 знаков (I,

V,

X,

L,

C,

D,

M),

которые соответствуют следующим

величинам: I

– 1, V

– 5, X

– 10, L

– 50, C

– 100, D

– 500, M

– 1000. Обычно римскими числами пользуются

при нумерации глав в книгах или веков

в истории. Недостатком непозиционных

систем счисления, исключающим возможность

их использования в вычислительной

технике, является отсутствие формальных

правил записи чисел и, соответственно,

невозможность выполнения арифметических

действий над ними. Рассмотрим

представление числа в позиционной

системе счисления. Начнём с простого

примера. Пусть N

– целое

число. Оно может быть представлено

краткой или развёрнутой записью. Краткая

запись числа: N

= (a n a n -1 …a 1 a 0) p Здесь a 0 ,

a 1 ,

… , a n -1 ,

a n

– цифры, находящиеся соответственно

на нулевой, первой, … , (n-1)-ой,

n-ой

позициях в записи числа. Нумерация

позиций, или разрядов, начинается с нуля

и идёт справа налево. 0 – это младший

разряд числа, имеющий наименьший вес;

n

– старший разряд с наибольшим весом.

Число p

– это основание системы счисления. Например, в числе

N = (6874) 10

цифра 4 представляет нулевой разряд, 7

– первый разряд, 8 – второй разряд, 6 –

третий разряд. Вес разрядов увеличивается

справа налево, от единиц до тысяч:

4 единицы

– 7 десятков

– 8 сотен

– 6 тысяч

.

10 – основание системы счисления –

указывает, что это число записано в

привычной для человека десятичной

системе счисления и читается как шесть

тысяч восемьсот семьдесят четыре

. Число N

может быть представлено развёрнутой

записью: N = a n p n

+ a n-1 p n-1

+ …

+ a 1 p 1

+ a 0 p 0 Здесь число N

выражено в виде суммы, каждое слагаемое

которой представляет произведение

цифры на основание системы счисления,

возведённое в степень, равную номеру

позиции (разряду) этой цифры в числе: цифра

(основание

)

номер

разряда Возвращаясь к

рассмотренному выше примеру, приведём

развёрнутую запись числа N = (6874) 10: (6874) 10

= 610 3

+ 810 2

+ 710 1

+ 410 0

. С развёрнутой

формой записи числа связан универсальный

способ перевода чисел из любой системы

счисления в десятичную. Например, требуется

перевести шестнадцатеричное число

(E7B) 16

в десятичную систему счисления. Сначала нумеруем

разряды числа – справа налево, от

младшего разряда к старшим. Учитываем,

что нумерация разрядов начинается с

нуля. Учтём соответствие

цифр шестнадцатеричной и десятичной

систем счисления: E

– 14, B

– 11. Тогда Итак, задача решена:

(E7B) 16

= (3707) 10

. Аналогичным

способом выполняется перевод дробных

чисел. Цифры, расположенные справа от

запятой, соответствуют разрядам с

отрицательными номерами. N =

(a n a n-1 …a 1 a 0 ,a -1 a -2 …a -k) p Рассмотрим перевод

дробного восьмеричного числа (725,46) 8

в десятичную систему счисления. Нумеруем разряды. Произведём

вычисления и получим результат в

десятичной системе счисления. (725,46) 8

= 78 2

+ 28 1

+ 58 0

+ 48 -1

+ 68 -2

=

448

+

16

+

5

+

4/8

+

6/64

= 448 + 16 + 5 + 0,5 + 0,09375

= 469,59375 Итак, (725,46) 8

= (469,59375) 10 . Несколько сложнее

выполняется перевод чисел из десятичной

в иные системы счисления. Методика основана

на последовательном целочисленном

делении с выделением остатков в качестве

цифр искомого числа. Исходное число

делят на основание системы счисления,

в которую осуществляют перевод.

Результатом целочисленного деления

будет частное, представленное целым

числом, и остаток. Этот остаток будет

младшим разрядом искомого числа.

Полученное на первом шаге частное снова

делят на основание требуемой системы

счисления, снова получают частное и

остаток. Остаток сохраняют в качестве

следующего разряда искомого числа.

Деление продолжают до тех пор, пока

очередное частное не окажется меньше

основания требуемой системы счисления.

Это частное будет старшим разрядом

искомого числа. Из него и остатков,

полученных на последнем и предыдущих

шагах, формируют искомое число. Разберём эту

методику на примере. Пусть, требуется

перевести число (894) 10

в семеричную систему счисления. 894: 7 = 127, остаток

5

127: 7 = 18, остаток

1

18: 7 = 2

,

остаток 4

Последнее частное

– 2 – меньше основания системы счисления,

в которую осуществляется перевод, – 7.

Теперь можно записать искомое число:

(2415) 7 . Итак, (894) 10

= (2415) 7 . Логические

основы ЭВМ Алгебра логики.

Логические высказывания

Предшественницей

и составной частью алгебры, по правилам

которой функционируют цифровые устройства

ЭВМ, является алгебра логики. Эта алгебра

оперирует логическими высказываниями,

содержание которых можно оценить как

соответствующее действительности

(истина) или несоответствующее

действительности (ложь). Логическое

высказывание – это повествовательное

предложение, истинность или ложность

которого можно оценить. Примеры истинных

высказываний: «вода – это жидкость»,

«после зимы наступит весна», «число 48

в 8 раз больше числа 6». Примеры ложных

высказываний: «река Кама впадает в озеро

Байкал», «воробей – это ястреб», «число

2 больше числа 3». В первом предложении

глагол употреблен в повелительном

наклонении. Побудительное предложение

не может быть логическим высказыванием. Второе предложение

не является логическим высказыванием

ввиду абсурдности понятий «площадь

отрезка» и «длина куба». Третье предложение

является вопросительным, поэтому оно

также не может быть логическим

высказыванием. Логическим

высказыванием, причем ложным, является

четвертое предложение. Первое предложение

представляет собой логическое

высказывание. Оно ложно, так как в

реальности ближайшей к Солнцу планетой

является Меркурий. Второе предложение

- не повествовательное, а восклицательное,

поэтому оно не является логическим

высказыванием. Третье предложение

могло бы быть логическим высказыванием,

если бы содержащихся в нем сведений

было достаточно, чтобы оценить его

истинность или ложность. Однако невозможно

судить о принадлежности числа X

указанному интервалу, так как само это

число неизвестно. Поэтому третье

предложение также не является логическим

высказыванием. Булева алгебра.

Основные логические операции

Логические

устройства ЭВМ проектируются на основе

математического аппарата булевой

алгебры, названной в честь английского

математика Джорджа Буля, сформулировавшего

ее основные понятия и правила. Это

алгебра двоичных переменных, констант

и функций, принимающих только два

значения – единица

(в алгебре логики ей соответствует

значение ИСТИНА) и ноль

(в алгебре логики – ЛОЖЬ). Основными операциями

булевой алгебры являются инверсия

,

конъюнкция

,

дизъюнкция

.

Их русские названия – соответственно

отрицание

,

логическое

умножение

,

логическое

сложение

.

Иначе - операции НЕ

,

И

,

ИЛИ

. Обозначения

логических операций булевой алгебры A

и B

– логические высказывания. Для наглядного

представления и выполнения логических

вычислений используют таблицы истинности. Ниже приведены

таблицы истинности основных логических

операций. Инверсия Инверсия – функция

одного аргумента, которым является

логическое высказывание A.

Если A

ложно, то Ā истинно, и наоборот. Конъюнкция

и дизъюнкция Конъюнкция и

дизъюнкция – функции двух и более

аргументов. Их результатом является

сложное (составное) логическое

высказывание, которое в зависимости от

значений аргументов функции принимает

значение 1 или 0. Таблица истинности

должна включать все возможные комбинации

значений аргументов – простых или

сложных логических высказываний. Всего

таких комбинаций 2 n ,

где n

– число аргументов. В простейшем случае,

когда оперируем двумя логическими

высказываниями A

и B,

таблицы истинности выглядят следующим

образом. Конъюнкция

Дизъюнкция Аргументы Результат Аргументы Результат Для произвольного

числа аргументов верны два правила. 1. Если

среди аргументов конъюнкции

есть хотя бы один, который всегда

принимает значение 0 (ЛОЖЬ), то результат

конъюнкции вне зависимости от значений

других аргументов тоже 0 (ЛОЖЬ). 2. Если

среди аргументов дизъюнкции

есть хотя бы один, который всегда

принимает значение 1 (ИСТИНА), то результат

дизъюнкции вне зависимости от значений

других аргументов тоже 1 (ИСТИНА). Приведенные таблицы

истинности подтверждают эти правила. Некоторые

высказывания обычного человеческого

языка можно сопоставлять логическим

функциям. Например, высказывание «Для

получения отличной оценки на экзамене

требуется как

наличие зачета по практике, так

и

хорошее знание

теоретического материала»

соответствует конъюнкции. Высказывание

«Чтобы кожа приобрела

загар, надо несколько дней провести на

пляже при жарком солнце или

несколько раз посетить солярий»

представляет дизъюнкцию. Еще пример

дизъюнкции: «Чтобы

похудеть, надо больше работать физически

и меньше есть.» Проиллюстрируем

последнее высказывание таблицей

истинности. Высказываниям,

представляющим конъюнкцию, обычно

соответствуют конструкции «A

и

B

», «как

A

,так и

B

», «A

вместе с

B

»;

представляющим дизъюнкцию – «A

или

B

». Могут быть

исключения: пример – разобранное в

конце предыдущей страницы предложение. Конструкциям

типа «или

A

,или

B

», «A

либо

B

», «либо

A

,либо

B

»

соответствует функция, называемаястрогой дизъюнкцией

. Ее отличие от

обычной дизъюнкции заключается в том,

что она равна 1 только в том случае, когда

значения ее аргументов различны.

Обозначение строгой дизъюнкции –A B,

другие ее названия –неравнозначность

,исключающее

ИЛИ (XORв

языках программирования),сложение

по модулю 2

. Ниже приведена таблица

истинности строгой дизъюнкции. Строгая

дизъюнкция (неравнозначность) В современной

алгебре логики определены еще две

основные операции – эквиваленция

и импликация

. Эквиваленция

(эквивалентность, равнозначность) –

это функция, противоположная строгой

дизъюнкции. Она принимает значение

ИСТИНА тогда, когда все ее аргументы

либо истинны, либо ложны. Ее обозначение:

A B. Эквиваленция

(равнозначность) Импликация –

функция двух логических аргументов. Ее

обозначение: A B.

Таблица истинности функции «импликация»

выглядит следующим образом. Импликация Импликация может

быть выражена через основные операции

булевой алгебры: A B

= A

B. В языках

программирования эквиваленции

соответствует функция EQV,

импликации – IMP. Функции «эквиваленция»

и «импликация» также могут быть соотнесены

с отдельными высказываниями русского

языка. Эквиваленции соответствуют

высказывания типа: «A

эквивалентно

B

» ;

«A

тогда и только тогда, когда

B

» ;

«A

необходимо и достаточно для

B

».

Импликации соответствуют конструкции:

«Если

A

,

то

B

» ;

«B

,

если

A

» ;

«B

необходимо

для

A

» ;

«A

достаточно

для

B

» ;

«A

только тогда,

когда

B

» ;

«B

тогда, когда

A

» .

Классическим примером импликации

является фраза «Если

идет дождь, то на небе тучи».

Обозначим A

=

«Идет

дождь», B

= «На

небе тучи»

и составим таблицу истинности. «Дождь не идет,

на небе нет туч» - ясный солнечный

день, составное

высказывание истинно

«Дождь не идет,

на небе тучи» - сухой пасмурный день, составное

высказывание истинно

«Идет дождь, на

небе нет туч» - такого не бывает, составное

высказывание ложно

«Дождь идет, на

небе тучи» - пасмурный дождливый день, составное

высказывание истинно

Надо подчеркнуть,

что формализация высказываний

человеческого языка носит весьма

ограниченный характер. Большинство

фраз и предложений русского языка, как

разговорного, так и литературного,

вообще не являются высказываниями с

точки зрения алгебры логики. Это связано

с наличием множества нюансов письма и

речи, которые невозможно охватить в

рамках формальной логики, с эмоциональной

окраской и субъективностью суждений,

а также с непреложностью того факта,

что в мире гораздо больше относительных

истин, чем абсолютных. Поэтому эксперименты

с соотнесением операций формальной

логики с высказываниями человеческого

языка применимы только к однозначно

воспринимаемым предложениям, констатирующим

самые общие и простые факты. Итак,

базисом современной алгебры логики

являются пять основных логических

операций: инверсия, конъюнкция, дизъюнкция,

импликация, эквиваленция. Все остальные

операции могут быть выражены комбинациями

трех операций булевой алгебры: инверсии,

конъюнкции и дизъюнкции. При анализе сложных

логических высказываний необходимо

помнить о приоритете логических операций:

при отсутствии скобок сначала выполняется

отрицание, далее в порядке убывания

приоритета идут конъюнкция, строгая

дизъюнкция, дизъюнкция, импликация и в

последнюю очередь – эквиваленция.

Скобки могут изменить этот порядок. В цифровой технике

широкое распространение получили

микросхемы, построенные на логических

элементах И-НЕ и ИЛИ-НЕ. Технологически

они реализуются наиболее просто.

Предпринимались даже попытки построения

компьютеров, состоящих только из этих

элементов. С ними связаны еще две двоичные

алгебры – алгебра Шеффера и алгебра

Пирса. Операция И-НЕ носит название

«штрих Шеффера», операция ИЛИ-НЕ –

«стрелка Пирса». Обозначения: соответственно

A B

и A B.

С позиций булевой алгебры обе эти

операции составные. A B

= A

B A B

= A

B Таблицы истинности

этих функций: Штрих

Шеффера Стрелка Пирса Аргументы Результат Аргументы Результат Обозначения в

цифровой технике.

Рис. 2.2. Зависимость количества семантической информации, воспринимаемой потребителем

равно 0:

, причем (2.2)

, причем (2.2)![]() (2.3)

(2.3)![]() (2.4)

(2.4)![]()

![]()

(2.5)

(2.5) (2.6)

(2.6)

blackhack.ru ОК. Настройки, новости, игры.

blackhack.ru ОК. Настройки, новости, игры.