Привет, Друзья! Дублирование контента на сайте носит хронический характер в электронной коммерции. Кажется, каждая платформа, независимо от того, насколько она оптимизирована для , создает некую форму повторяющегося материала, не давая сайту достигнуть максимальной производительности.

Как дублирование контента на сайте убивает SEO

Для начала давайте разберемся, что такое дублирующий контент. Возможно, это не совсем то, о чем вы думаете.

Вопреки распространенному мнению, санкций за дублируемый контент не существует. Ещё в 2008 году Google в своем блоге написали: «Давайте расставим все по местам раз и навсегда, ребята. Такой вещи, как наказание за дублируемый контент, попросту нет».

И все же существует вполне реальная, но менее заметная проблема с подобным контентом. Алгоритмическое ослабление или снижение эффективности происходит со всеми типами страниц, содержащих повторяющиеся материалы.

Дублированный контент на сайте конкурирует сам с собой по одним и тем же ключевым словам в тематике и делит весомость ссылки между двумя или большим количеством страниц.

Две вещи напрямую указывают на важность в поисковых системах:

- релевантность

- авторитет

Наличие более одной страницы, таргетированной одними и теми же , делает их все менее релевантными по для поисковых машин, поскольку им сложно определить, какую именно страницу необходимо ранжировать. И поскольку несколько страниц связаны одинаковыми ключами, ссылки, которые могли бы подкреплять одну страницу, вместо этого слабо поддерживают каждую из этих страниц, не принося ни одной из них преимущества.

Ослабление в таком случае означает более слабые сигналы, посылаемые сайтом в поисковые системы, что влияет на возможность его ранжирования.

Почему за это нет наказаний?

В мире Google наказание назначается вручную реальным человеком из отдела веб-качества системы, когда конкретная страница или сайт попадают под установленное определение спама. Кто-то должен физически применять санкции к ресурсу, если это действительно наказание. Ослабление же алгоритмическое явление по своей природе и его сложнее определить, поскольку Google не будет предупреждать вас о нем, как это происходит в случае с установленным вручную штрафом через Google Search Console.

Нежелательные эффекты

Проблема избавления от дублированного контента состоит в том, что простое удаление страниц может повлечь за собой пару нежелательных эффектов.

В некоторых случаях вашим покупателям необходимо видеть такие страницы. Отсортированные сетки просмотра, страницы списка желаний, страницы для печати и т. п. могут быть технически дублированным контентом. Удаление этих страниц может повредить вашему клиенту и, возможно, вашему доходу.

Авторитетность ссылки

Каждый индексируемый URL имеет мало-мальский вес. Простое уничтожение страниц в конечном счете приводит к потере авторитетности ссылки, и по иронии, в попытках помочь своей SEO, вы ей навредите.

Цель состоит в том, чтобы точно определить, чего вам нужно добиться:

- Вы хотите удалить страницу для поисковых систем, но сохранить ее для покупателей?

- Вам нужно ликвидировать страницу как для покупателей, так и для поисковых систем?

- Важнее избавиться от страницы немедленно (по юридическим или иным причинам), независимо от ее влияния SEO, или же вы пытаетесь улучшить SEO при помощи запланированных действий?

Следующая таблица поможет вам в процессе принятия решения.

7 способов избавиться от дублированного контента

Первой в списке идет переадресация 301 – главная звезда в SEO. По возможности используйте именно этот метод удаления дублированного контента, поскольку только он позволяет достичь сочетания перенаправления бота и клиента, передавая ссылку на новый URL-адрес и удаляя старый. В отличие от некоторых других вариантов Переадресация 301 — это команда для поисковых систем, а не просто запрос, который может быть проигнорирован.

Если ваша команда разработчиков избегает этот метод, или если покупатели должны продолжать видеть страницу, которую поисковые системы считают дублированным контентом, попробуйте в качестве замены канонические теги (Canonical). Им по-прежнему требуется поддержка разработчиков, но для них понадобится меньше тестирований во время внедрения и меньшее использование ресурсов сервера на их существование. Однако имейте в виду, что Google может проигнорировать канонические теги, если посчитает, что вы допустили ошибку, или просто сочтет, что нет необходимости им подчиняться по какой-либо алгоритмической причине.

Третьей в списке идет переадресация 302, хотя она присутствует в списке только потому, что связана с всемогущей переадресацией 301. По словам инженера Google Джона Мюллера, 302 переадресация действительно перенаправляет полномочия ссылки, но в 99% случаев нет причин проверять эту теорию, поскольку переадресация 301 дает больше при тех же усилиях. Причиной для использования переадресации 302 может быть ситуация, когда необходимо временное перенаправление, и Google не должен деиндексировать страницу, поскольку она скоро вернется.

Удаленный контент наносит вред

Оставшиеся четыре метода только деиндексируют контент. Они не перенаправляют или покупателя, и они не передают полномочия ссылки другой странице. Поэтому используйте их, если они являются единственным жизнеспособным вариантом, поскольку уничтожение страниц без перенаправления с них тратит ресурсы ссылок.

Авторитетность ссылки — самый ценный и труднодоступный продукт в естественном поиске. Вы можете создать прекрасный контент, можете оптимизировать свою на своем сайте, направляя авторитетность туда, где она необходима. Но этический рост весомости ваших ссылок, с поистине разнообразной и авторитетной коллекцией внешних сайтов, требует редкого сочетания удачи, цифрового охвата, отношений с прессой, офлайн-маркетинга и т. д. Сайты, которым удалось этому научиться, весьма немногочисленны и редки.

Если вам необходимо уничтожить страницу, определитесь, нужно ли от нее избавиться исключительно по причинам SEO (например, дублированный контент) или же по юридическим причинам (например, больше никто и никогда не должен ее видеть). Если вы всего лишь хотите временно исключить его из Google, это можно быстро и легко сделать в Google Search Console, воспользовавшись инструментом «Удалить URL-адреса» (Индекс Google> Удалить URL-адреса). Для клиентов страница будет по-прежнему отображаться при просмотре, но Google немедленно уберет ее из индексации.

Будьте осторожны с этим инструментом. При неправильном использовании он способен деиндексировать весь ваш сайт.

Единственный способ исключить страницу из доступа как для людей, так и для бота – удалить ее с серверов, тем самым заставляя URL выдавать ошибку 404 File not found или, используя переадресацию 301, перенаправлять на новый URL.

Метатеги noindex для роботов и команды robots.txt disallow стоят последними в этом списке по ряду причин:

На этом сегодня всё, всем удачи и до новых встреч!

Дубли контента – это частично или полностью одинаковый текст, картинки и прочие элементы наполнения сайта, доступные по разным адресам страниц (URL). Наличие дублей может значительно затруднять поисковое продвижение сайта.

По оценке специалистов, дублированный контент – самая распространенная ошибка внутренней оптимизации, присутствующая на каждом втором веб-ресурсе.

Как проверить, есть ли дубли на вашем сайте, и каким образом от них избавиться? Об этом мы расскажем в новом выпуске нашей рассылки.

Какие бывают дубли

Дубли бывают четкие и нечеткие (или полные и неполные).

Четкие дубли – страницы-копии с абсолютно одинаковым контентом, содержимым мета-тега Description и заголовка Title, доступные по разным адресам. Например, у исходной страницы могут появиться следующие дубли:

- зеркало с WWW или без;

- страницы с разными расширениями (.html, .htm, index.php, GET-параметром «?a=b» и т. д.);

- версия для печати;

- версия для RSS;

- прежняя форма URL после смены движка;

- и так далее.

Нечеткие дубли – частично одинаковый контент на разных URL.

В качестве примеров таких дублей можно привести следующие варианты:

- карточки однотипных товаров с повторяющимся или отсутствующим описанием;

- анонсы статей, новостей, товаров в разных рубриках, на страницах тегов и постраничной разбивки;

- архивы дат в блогах;

- страницы, где сквозные блоки по объему превосходят основной контент;

- страницы с разными текстами, но идентичными Title и Description.

Чем опасны дубли для продвижения

1. Затрудняется индексация сайта (и определение основной страницы)

Из-за дублей количество страниц в базе поисковых систем может увеличиться в несколько раз, некоторые страницы могут быть не проиндексированы, т. к. на обход сайта поисковому роботу выделяется фиксированная квота количества страниц.

Усложняется определение основной страницы, которая попадет в поисковую выдачу: выбор робота может не совпасть с выбором вебмастера.

2. Основная страница в выдаче может замениться дублем

Если дубль будет получать хороший трафик и поведенческие метрики, то при очередном апдейте он может заменять основную (продвигаемую) страницу в выдаче. При этом позиции в поиске «просядут», т.к. дубль не будет иметь ссылочной популярности.

3. Потеря внешних ссылок на основную страницу

4. Риск попадания под фильтр ПС

И Яндекс, и Google борются с неуникальным контентом, в связи с чем могут применить к «засоренному» сайту фильтры АГС и Panda.

5. Потеря значимых страниц в индексе

Неполные дубли (страницы категорий, новости, карточки товаров и т. д.) из-за малой уникальности имеют шанс не попасть в индекс поисковиков вообще. Например, это может случиться с частью товарных карточек, которые поисковый алгоритм сочтет дублями.

Как найти и устранить дубли на сайте

Будучи владельцем сайта, даже без специальных знаний и навыков вы сможете самостоятельно найти дубли на вашем ресурсе. Ниже дана инструкция по поиску и устранению дублированного контента.

Поиск полных дублей

Самый быстрый способ найти полные дубли на сайте – отследить совпадение тегов Title и Description. Для этого можно использовать панель вебмастера Google или популярный у оптимизаторов сервис Xenu. Поиск ведется среди проиндексированных страниц.

Минусы: не все дубли можно (и нужно) удалять (например версии страниц с рекламными метками); трудоемкая работа, занимающая при большом количестве страниц много времени. Не исключает появления новых дублей. Вес с дублей не передается основной странице.

- Плюсы: не требует специальных навыков программирования.

6. Готовые решения для популярных CMS

Разработчики популярных CMS предусмотрели ряд решений, предотвращающих появление дублей. При этом вебмастерам при работе с движком необходимо внимательно выставлять настройки. Если вы что-то упустили из виду и дубли все же появились, никогда не поздно все исправить и устранить копии. Внятные инструкции по настройкам движка и использованию SEO-плагинов можно найти на профильных блогах и на форумах WordPress, Joomla, Drupal, Битрикс, а также других широко представленных CMS.

Полезные SEO-плагины для борьбы с дублями:

- WordPress: All in One SEO Pack, Clearfy;

- Drupal: Global Redirect, Page Title;

- Joomla: Canonical Links All in One, JL No Dubles.

7. Борьба на уровне движка

Универсальное решение для самых разных CMS – предупредить появление новых дублей на уровне движка. Необходимо задать такое условие, при котором в процессе обработки адресных ссылок CMS будет отличать «хорошие» от «плохих» и отображать в строке браузера только те, которые разрешены правилом. Это позволит избежать формирования страниц-синонимов (со знаком «/» и без него, с ненужным окончанием.html, GET-параметрами и проч.), однако не защитит от возникновения дублей, если у страниц не будут уникализированы Title и Description.

Для реализации данного метода в файле.htaccess необходимо включить следующее правило:

RewriteEngine on RewriteCond %{REQUEST_FILENAME} !-d RewriteCond %{REQUEST_FILENAME} !-f RewriteRule ^(.*)$ index.php

Кроме этого, следует реализовать необходимые проверки в самом движке.

Метод отличается высокой сложностью и требует обращения к специалистам по разработке.

- Минусы: крайне высокая степень сложности.

- Плюсы: предотвращает появление страниц-синонимов.

Поиск неполных дублей

1. Ищем при помощи вебмастера Google или сервиса Xenu

Алгоритм действий в этих сервисах абсолютно такой же, как и для поиска полных дублей. Единственное отличие заключается в том, что среди найденных дублей необходимо отобрать те страницы, которые имеют идентичные Title и/или Description, но совершенно разный контент.

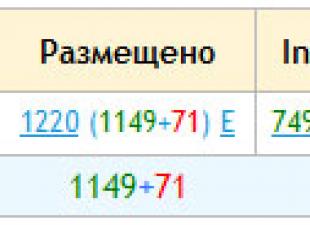

В результате поиска в Google мы обнаружили группу неполных дублей (Рис. 2).

Рис. 2. Совершенно разные новости с дублированными мета-данными

Рис. 2. Совершенно разные новости с дублированными мета-данными 2. Ищем в строке поиска Яндекса или Google

Страницы с частично похожим контентом, но разными мета-данными указанным выше способом выявить не удастся. В этом случае придется работать вручную.

Для начала условно выделите зоны риска:

- скудный контент (сквозные блоки по объему превосходят основной текст страницы);

- копированный контент (описание схожих товаров);

- пересечение контента (анонсы, рубрики/подкаталоги, фильтры, сортировка).

Из каждой группы выберите несколько страниц.

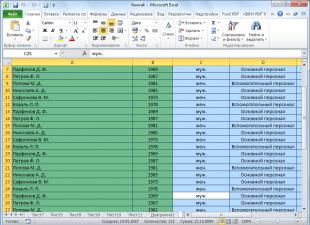

Для наглядной иллюстрации примера мы воспользовались одной из карточек товаров на сайте мебельного магазина, проходившего аудит в нашей рубрике «Экспертиза». Вероятность появления дублей здесь достаточно высока, так как в карточках преобладают картинки и сквозные блоки, а уникальный контент сведен к минимуму.

Указываем в строке поиска Google фрагмент текста из описания товара, заключенный в кавычки, и домен сайта с оператором site: (Рис. 3).

» я уже касался темы дублированных страниц и сегодня поговорим об этом более подробно.

Что такое дубли страниц ? Это страницы с похожим или одинаковым текстом доступные по разным URL адресам. Например, очень часто встречающиеся дубли главной страницы ресурса

Ниже мы рассмотрим несколько распространенных вариантов дублирования контента, а сейчас давайте поговорим о том, как влияют похожие страницы на продвижение сайта.

Поисковые системы давно научились определять уникальность текста по последовательности символов, т.е по одинаково составленным предложениям, откуда берется последовательность букв и пробелов. Если контент не уникальный (ворованный), то робот без труда это выяснит, а когда не уникальный текст встречается часто, то перспектива попадания такого ресурса под фильтр АГС довольно высока.

Давайте представим себе работу поискового робота. Зайдя на сайт он в первую очередь смотрит на файл robots.txt и от него получает инструкции: что нужно индексировать и что для индексации закрыто. Следующим его действием будет обращение к файлу sitemap.xml, который покажет роботу карту сайта со всем разрешенными маршрутами. Почитайте статью — «Файл sitemap.xml для поисковиков Google и Яндекс .» Получив всю необходимую информацию, робот отправляется выполнять свои привычные функции.

Зайдя на определенную страницу он «впитывает» ее содержимое и сравнивает с уже имеющейся в его электронных мозгах информацией, собранной со всего бескрайнего простора интернета. Уличив текст в не уникальности поисковик не станет индексировать данную страницу и сделает пометку в своей записной книжке, в которую он заносит «провинившиеся» URL адреса. Как Вы наверное уже догадались на эту страницу он больше не вернется, дабы не тратить свое драгоценное время.

Допустим, страница имеет высокую уникальность и робот ее проиндексировал, но пройдя по следующему URL того же ресурса он попадает на страницу с полностью или частично похожим текстом. Как в такой ситуации поступит поисковик? Конечно он тоже не станет индексировать похожий тест, даже если оригинал находиться на том же сайте, но по другому URL. Робот наверняка останется недоволен бесполезно потраченным временем и обязательно сделает пометочку в своем блокноте. Опять же, если такой инцидент будет неоднократно повторяться, то ресурс может пасть в немилость к поисковой системе.

Вывод №1. Похожие страницы расположенные по разными URL отнимают время, которое отводится роботу для индексации сайта. Дубли страниц он все равно индексировать не будет, но потратит часть временного лимита на ознакомление с ними и возможно не успеет добраться до действительно уникального контента.

Вывод№ 2. Дублированный контент отрицательно скажется но продвижении сайта в поисковой системе. Не любят поисковики не уникальные тексты!

Вывод №3. Надо обязательно проверять свой проект на дубли страниц, чтобы избежать проблем перечисленных выше.

Многие совершенно не заботятся об «чистоте» своего контента. Ради интереса я проверил несколько сайтов и был несколько удивлен положению дел с дублями страниц. На блоге одной женщины я вообще не обнаружил файла robots.txt.

Необходимо со всей серьезность бороться с дублями контента и начинать надо с их выявления.

Примеры часто встречающихся дублей контента и способы устранение проблемы

Дубль главной страницы. Пример:

- http://сайт.com

- http://сайт.com/index.php.

В этом случаи вопрос решается с помощью 301 редиректа — «командой» для сервера через файл.htaccess.

Еще один пример дубля главной страницы:

- http://сайт.com

- http://www.сайт.com

Чтобы избежать подобного дублирования можно прописать основное зеркало сайта в файле robots.txt в директиве — «Host» для Яндекс:

- Host: сайт.com

А также воспользоваться 301 редиректом и указать поисковикам Яндекс и Google на главное зеркало сайта посредством инструментов для веб-мастеров.

Пример дубля главной страницы, который чуть не взорвал мне мозг при поиске решения выглядит так:

- http://сайт.com

- http://сайт.com/

Я где-то прочитал, что слеш в конце ссылки на главную страницу, создает дубль и поисковики воспринимают ссылки со слешом и без, как разные URL, ведущие на страницу с одинаковым текстом. Меня забеспокоила даже не сама возможность дублирования, сколько потеря веса главной страницы в такой ситуации.

Я начал копать. По запросу к серверу по вышеупомянутым URL я получил ответ код 200. Код 200 означает — » Запрос пользователя обработан успешно и ответ сервера содержит затребованные данные». Из этого следует, что все-таки дубль на лицо.

Я даже попытался сделать 301 редирект (перенаправление), но команды не действовали, и желанного ответного кода 301 я так и получил. Решение проблемы состояло в отсутствии самой проблемы. Каламбур такой получился. Оказывается, современные браузеры сами подставляют символ «/» в конце строки, делая его невидимым, что автоматически делает дубль невозможным. Вот так!

Ну и еще один пример дубля главной страницы:

- http://сайт.com

- https://сайт.com

Бывают случаи, что по ошибке веб-мастера или глюка поисковика или при других обстоятельствах в индекс попадает ссылка под защищенным протоколом https://. Что же делать в таком случаи и как избежать этого в будущем? Конечно надо удалить ссылки с протоколом https://из поиска, но делать придется в ручную средствами инструментов для веб-мастеров:

В поисковой системе Яндекс, веб- мастер — мои сайты — удалить URL:

Важно ! Директивы, прописанные в файле robots.txt, запрещают поисковым роботам сканировать текст, что уберегает сайт от дублей, но те же директивы не запрещают индексировать URL страниц.

Подробнее читайте в статьях:

Есть еще один довольно действенный способ определения «клонов» с помощью самих поисковых систем. В Яндексе в поле поиска надо вбить: link.сайт.com «Фрагмент теста». Пример:

Яндекс нашел 2 совпадения потому, что я не закрыл от индексации категории и поэтому есть совпадение с анонсом на главной странице. Но если для кулинарного блога участие рубрик в поиске оправдано, то для других тематик, таких как SEO такой необходимости нет и категории лучше закрыть от индексации.

С помощью поиска Google проверить можно так: site:сайт.com «Фрагмент текста». Пример:

Программы и онлайн сервисы для поиска внутренних и внешних дублей контента по фрагментам текста

Я не буду в этой статье делать подробный обзор популярных программ и сервисов, остановлюсь лишь на тех, которыми сам постоянно пользуюсь.

Для поиска внутренних и внешних дублей советую использовать онлайн сервис www.miratools.ru . Помимо проверки текста сервис включает еще различные интересные возможности.

Программа для поиска дублей — Advego Plagiatus . Очень популярная программа, лично я ей пользуюсь постоянно. Функционал программы простой, чтобы проверить текст достаточно скопировать его и вставить в окно программы и нажать на старт.

После проверки будет представлен отчет об уникальности проверяемого текста в процентах с ссылками на источники совпадений:

Также, будут выделены желтым фоном конкретные фрагменты текста, по которым программы нашла совпадения:

Очень хорошая программа, пользуйтесь и обязательно подпишитесь на обновления блога .

До встречи!

С уважением, Кириллов Виталий

Контент (англ. content — содержимое) - информация, а именно, текст, изображения, видео, файлы, которые расположены на сайте.Он должен быть:

- Дающим наиболее полный и понятный ответ, решающим проблему человека: будь то поднять настроение, покончить со сложной дилеммой или приобрести качественный товар.

- Без использования скрытых фрагментов, таких как:

- текст одного цвета с фоном,

- текст скрыт изображением, располагаясь позади него,

- размер шрифта равен значению 0.

- главные мысли выделены цветом или жирностью, чтобы пользователь сфокусировал на них внимание. Не забывайте, что веб-страницы не читаются, а мельком просматриваются.

- через реализована структура статьи,

- предложения объединены в абзацы, между которыми присутствует пустая строка,

- использованы списки, цитаты, таблицы,

- применены картинки, инфогра́фика, видеоролики, аудиозаписи. Изображения играют большую роль. Так, один читатель данного блога попросил перевести символы на скриншоте, на котором был изображён редактор Blogger.

Дублирование контента можно наблюдать не только при размещении данных на разных сайтах, но и при повторении информации на двух и более одного веб-проекта. Вот эксперимент на devvver.ru о негативе внутренних дубликатов и как этим могут воспользоваться конкуренты.

Рассмотрим какие инструменты у нас есть в борьбе с этим недугом.

Ссылки на страницу

Единственный стопроцентный способ не дать проиндексироваться странице - не размещать на неё ссылки, и не добавлять её в аддурилки Яндекса , Google и т.п.

Файл robots.txt

Текстовый файл robots.txt (например, ) прекрасный инструмент для управления индексацией. Справка Yandex , Google . Но если Гугл найдёт ссылку на закрытый в robots.txt URL, то он добавит его в выдачу.

Из-за этого здесь нужно вписывать только те веб-документы, до которых нельзя добраться иным путём , например, . И, конечно, sitemap для более качественной и быстрой индексации востребованных страниц.

HTTP заголовок

URL не будет проиндексирован, если показывает 404 или 301. А для Google, ещё и когда присутствует строка

X-Robots-Tag: noindex

Мета-теги robots

Это главный инструмент , потому что работает он и для Яндекса и для Гугла одинаково. На странице, доступ к содержимому которой должен быть запрещён, указывается:

Атрибут rel="canonical"

Обязательный атрибут rel="canonical" подсказывает предпочитаемый из нескольких web-документов с очень похожим содержанием, например, http://сайт/2010/07/kontent..html?showComment. Второй поисковая система проигнорирует, поскольку подчинится строке:

Яндекс.Вебмастер

media="print"

Не нужно создавать отдельную версию для печати. Стили можно скорректировать с помощью .

Удаление дубликатов, находящихся в индексе по ошибке

Несмотря на предпринятые меры, поисковые роботы могут проиндексировать нежелательную страницу. Задав запрос

Просмотрите всю выдачу, особенно с опущенными результатами в Гугле. В идеале этой надписи не должно быть:

Опущенные результаты надо убирать вручную. Для Yandex воспользуемся формой удаления страницы , а для Google нужно зайти в "Инструменты для веб-мастеров"-"Оптимизация"-"Удалить URL-адреса"-"Создать новый запрос на удаление".

Многие владельцы сайтов уделяют внимание главным образом тому, чтобы контент был уникален по сравнению с другими ресурсами. Однако не стоит упускать из виду наличие дублированного контента в пределах одного сайта. Это тоже оказывает сильное влияние на ранжирование.

Что такое дублированный контент

Повторяющийся, или дублированный, контент – это совпадающие в рамках сайта объемные блоки текста на разных страницах. Не обязательно такое делается со злым умыслом – чаще возникает по техническим причинам, подробно разобранные ниже.

Опасность состоит в том, что часто дублированный контент невозможно увидеть невооруженным глазом, однако поисковик его прекрасно видит и реагирует соответствующим образом.

Откуда берется дублированный контент и где он чаще встречается

Основные причины возникновения такого явления:

- Изменение структуры сайта;

- Намеренное использование в конкретных целях (скажем, версии для печати);

- Ошибочные действия программистов и веб-мастеров;

- Неувязки с CMS.

Например, часто встречается ситуация: replytocom (ответ на комментарий) в WordPress автоматически формирует и новые страницы с разными URL-адресами, но не содержимым.

Обычно дублированный контент замечается при создании анонсов статьи на других страницах сайта, размещении отзывов, а также при одинаковых описаниях товаров, категорий, рубрик.

Почему дублированный контент – это плохо

У повторяющегося содержимого есть аналог из области экономики – банковский овердрафт. Только здесь расходуется так называемый краулинговый бюджет. Это число страниц ресурса, которое за конкретный промежуток времени сможет просканировать поисковая машина. Ресурс очень ценный, и лучше потратить его на действительно важные и актуальные страницы, чем на десятки дублей идентичного текста.

Таким образом, дублированный контент ухудшает поисковое продвижение. Кроме того, теряются естественные ссылки и неверно распределяется ссылочный вес внутри сайта. А также подменяются по-настоящему релевантные страницы.

Как найти дублированный контент на сайте (вручную, программы и сервисы)

Существуют специальные программы для анализа ресурсов. Из них пользователи особенно выделяют Netpeak Spider. Она ищет полные копии страниц, совпадения по тайтлу или дескрипшену, заголовкам. Другой вариант — Screaming Frog, которая обладает схожим функционалом и по сути отличается только интерфейсом. Еще есть приложение Xenu`s Link Sleuth, работающее схожим с поисковиком образом и способное довольно качественно прочесать сайт на наличие дубликатов.

К сожалению, нет инструментов, способных полноценно отслеживать все дубли текста. Поэтому, скорее всего, придется производить ручную проверку. Вот список возможных факторов, повлекших за собой проблему:

Разобрались, как найти дублированный контент. А лучшие помощники в борьбе с ним – это переадресация 301, теги Canonical URL, указания в robots.txt и параметры Nofollow и Noindex в составе мета-тега «robots».

Одним из способов на скорую руку проверить, если ли на сайте дублированный контент, является расширенный поиск в Яндексе или Гугле. Необходимо ввести адрес сайта и кусок текста со страницы, которую решили проверить. Также можно использовать многочисленные программы для проверки уникальности текста:

- Text.Ru;

- eTXT Антиплагиат;

- Advego Plagiatus;

- Content-Watch.

Как бороться и чистить дублированный контент

Всё та же справочная система Гугл дает ряд советов по предотвращению появления данной проблемы.

- 301. При структурных изменениях ресурса необходимо указывать редирект 301 в файле htaccess.

- Используйте единый стандарт ссылок.

- Контент для конкретного региона лучше размещать на доменах верхнего уровня, чем на поддоменах или в поддиректориях.

- Устанавливайте предпочтительный способ индексирования с помощью Search Console.

- Не используйте шаблоны. Вместо того, чтобы на каждой странице размещать текст о защите авторского права, лучше сделать ссылку, которая будет вести на отдельную страницу с этим текстом.

- Разрабатывая новые страницы, следите, чтобы до полной готовности они были закрыты от индексации.

- Разберитесь, как именно отображается ваш контент – могут быть отличия отображения в блогах и форумах.

- Если на сайте много схожих статей, лучше или объединить их содержимое в одно целое, или уникализировать каждую.

Поисковиками не предусмотрено никаких санкций по отношению к сайтам, имеющим дублированный контент по техническим причинам (в отличие от тех, кто делает это намеренно с целью манипулировать результатами поиска или вводить в заблуждение посетителей).

После того, как дубли удалены, осталось убрать их из поисковой выдачи. Яндекс делает это самостоятельно, при условии, что файл robots.txt настроен должным образом. Что касается Google: там придется вручную прописать правила в Вебмастере, на вкладке «Параметры URL».

Заключение

Борьба с дублированным контентом на сайте – важный аспект деятельности владельца любого сайта. Причин его возникновения довольно много, и столь же много способов устранения.

Однако главным правилом остается: размещать исключительно оригинальный контент, независимо от типа сайта. Даже если это крупный сетевой магазин с тысячами страниц.

ПОЛУЧАЙТЕ АНОНСЫ ПОДОБНЫХ ПОСТОВ СЕБЕ НА ПОЧТУ

Подпишитесь и получайте не чаще, чем раз в неделю что-нибудь интересное из мира интернет-маркетинга, SEO, продвижения сайтов, интернет-магазинов, заработка на сайтах.

blackhack.ru ОК. Настройки, новости, игры.

blackhack.ru ОК. Настройки, новости, игры.